OpenAIは2026年3月5日、同社のフロンティアモデルの最新バージョンGPT-5.4をリリースした。

GPT-5.4は推論に加え、これまで別モデルで実現してきたコーディング、エージェントワークフロー対応の最新機能を単一のモデルに統合し、それぞれ最高の性能を発揮する。また、さらに複雑雑なタスクで最高のパフォーマンスを発揮する「GPT-5.4 Pro」もリリースされた。

ChatGPTでは推論モデル「GPT-5.4 Thinking」が利用できる。GPT-5.4 Thinkingはより長く複雑なクエリに対応して事前プランを提供し、これをもとに応答の途中で指示を追加したり、方向を調整することができる。これにより作業を最初からやり直したり、追加操作をいくつも加えることなく正確な結果を得ることが容易になる。GPT-5.4 Thinkingはchatgpt.com およびAndroidアプリで利用可能で、iOSアプリも近日中にリリースされる予定。

またコーディングエージェントCodexやAPIからも専用モデルを使うことなく利用できる。最大100万トークンのコンテキストをサポートし、エージェントが長時間タスクを計画、実行、検証可能となった。トークンの利用効率も前モデルより大幅にアップしたため、推論能力においても速度が向上している。コーディングにおいてもGPT-5.4は既存のコーディング専用モデルGPT-5.3-Codexの機能をもち、より高いパフォーマンスを発揮する。

そしてGPT-5.4は「ビルトインコンピュータ使用機能」を備えた初のメインラインモデル。Playwrightなどのライブラリを介してコンピューターを操作するコードを作成したり、エージェントがソフトウェアと直接やり取りしてビルドを実行、またスクリーンショットを読み取りマウスやキーボードのコマンドを発行するといった操作が可能となる。

このほか「ツール検索機能」により、AIエージェントが目的の達成度を犠牲にすることなく適切なツールをより効率的に見つけて使用できるようになった。ツールを多用するワークフローに必要なトークン数が大幅に削減されるため、数万個のツール定義トークンを含むようなMCPサーバーを利用する場合など、効率性は飛躍的に向上するという。そしてコーディングではCodexで「/fastモード」が使用できるようになった。/fastモードをオンにすると、GPT-5.4でトークン速度が最大1.5倍高速になる。

こうした機能により、GPT-5.4は単一モデルでありながらChatGPT、Codex、そしてエージェント利用のAPIすべてで、より信頼性が高く高速な動作と高品質な出力を実現する。なお、他のGTP-5シリーズと同様に、GPT-5.4は2025年8月までの世界知識を元に動作する。

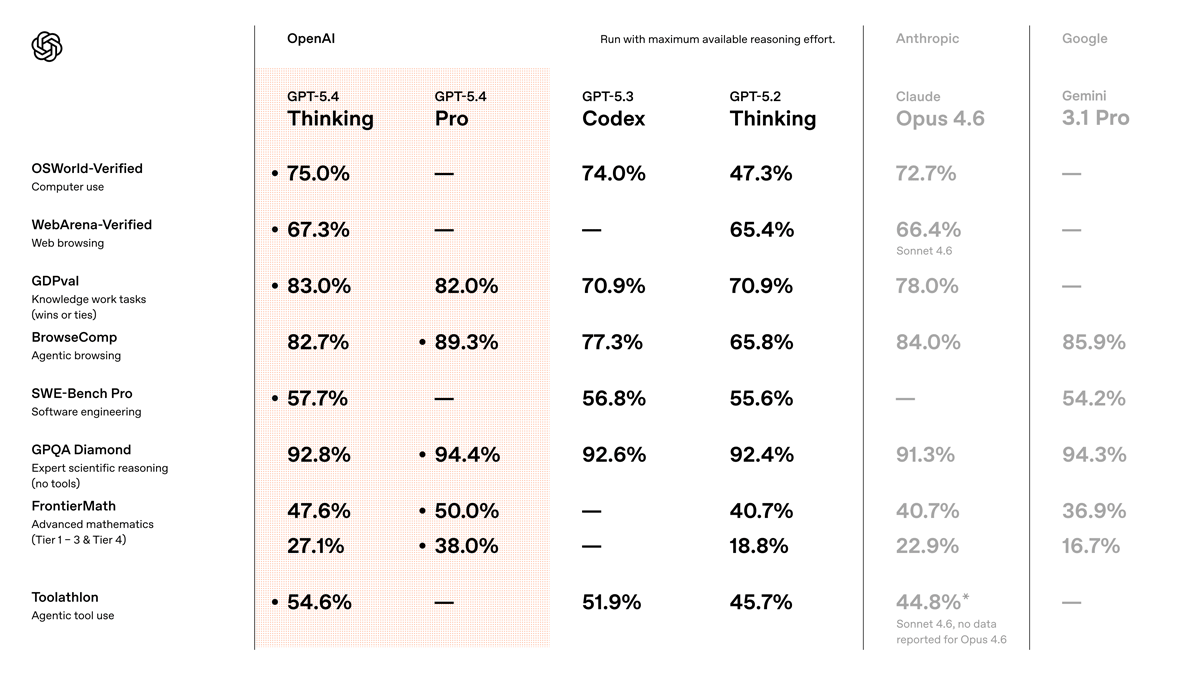

同社による各種ベンチマークの結果。GPT-5.4はビルトインコンピュータ使用によるデスクトップナビゲーション、Webブラウザ操作,エージェント/ツール操作,コーディング、科学分析、数学等において従来の専用モデルやCloude Opus 4.6、Gemini 3.1Proといった他社のフラッグシップモデルを上回る性能をマークしている。

GPT-5.4は、ChatGPTとCodex全体で3月5日から段階的に導入される。APIではすでに利用可能となっており、最も複雑なタスクで最高のパフォーマンスを求めるユーザー向けオプション「GPT-5.4 Pro」も利用できる。

またChatGPT Plus、Team、Proのユーザーは、GPT-5.4 Thinkingを利用できる。EnterpriseプランおよびEduプランを利用している場合は、管理者設定からGPT-5.4 Thinkingの早期アクセスを有効化できる。GPT-5.4 ProはProプランおよびEnterpriseプランで利用可能。CodexのGPT-5.4には試験的に1MBのコンテキストウィンドウのサポートが含まれている。これによりコードベース全体や長いドキュメント、または拡張エージェントの軌跡を1回のリクエストでカバーすることも可能。標準の272KBのコンテキストウィンドウを超えるリクエストは通常の2倍のレートでカウントされるので注意が必要。

なおAPIの利用料金は従来のGPT-5.2の約1.5倍となっているが、同社ではトークン効率の向上により、必要なトークンの総数を削減できるため影響は抑えられるとしている。