2023年9月13日。Adobeの生成AIモデル、Adobe Fireflyは商用利用も可能な生成AIサービスのひとつとなりました。次から次へと、こうした生成AIサービスが登場する一方で、生み出されたコンテンツが社会にも影響を与え始めています。今回は、革新的な技術である生成AIについて、その問題点を確認しながら、今後の普及について考えていきます。

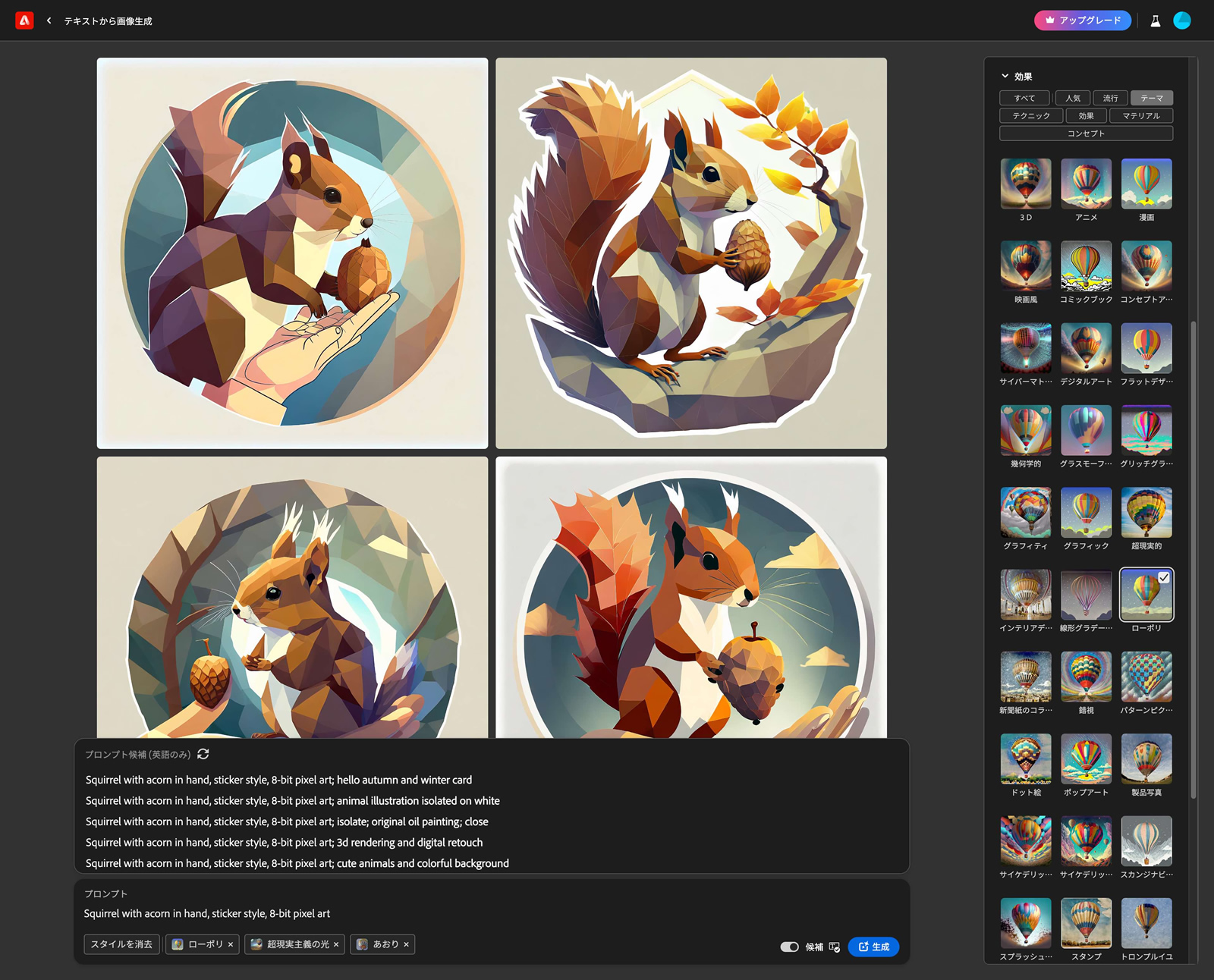

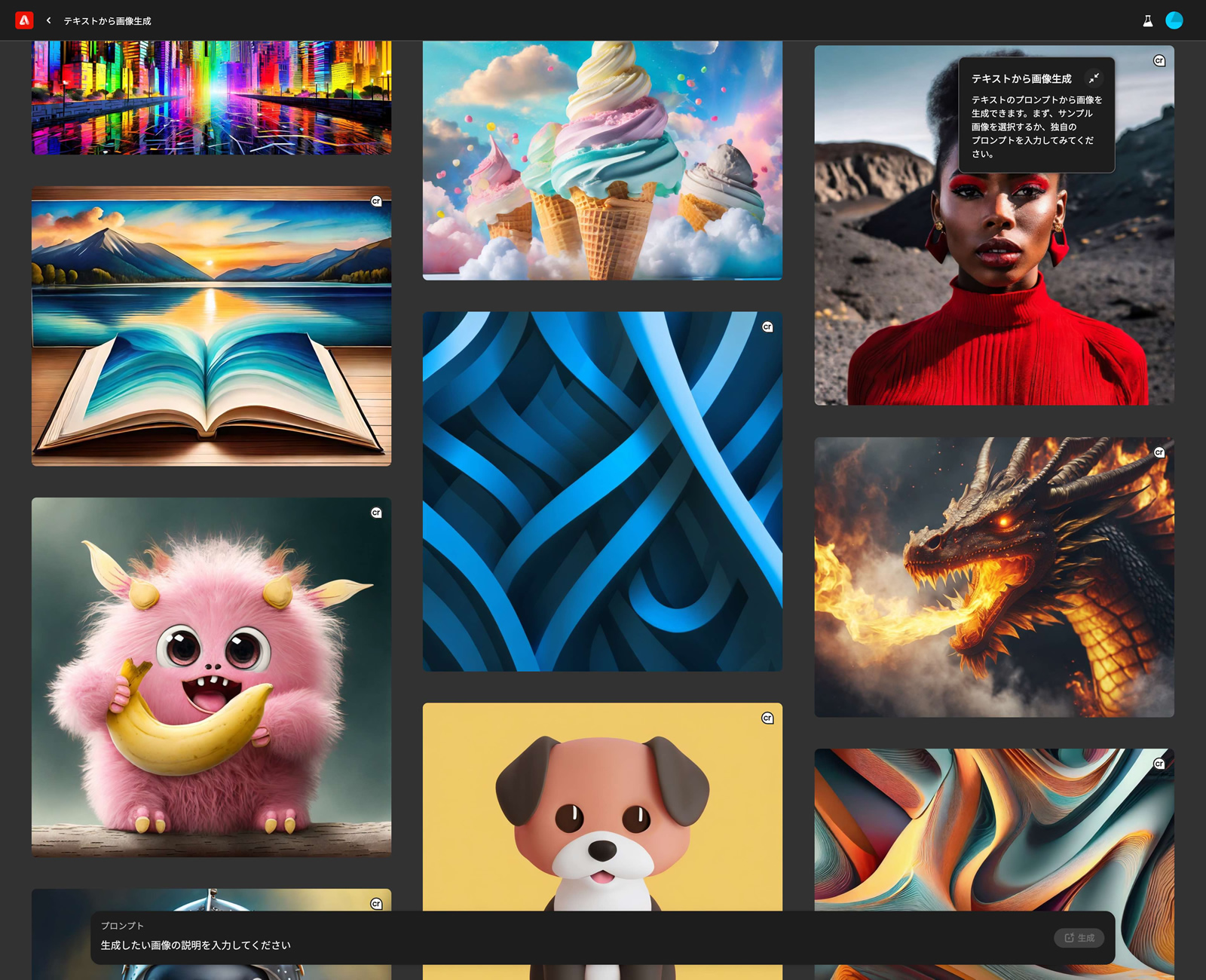

「Adobe Firefly web版」の「テキストから画像生成」で、画像を生成している途中の画面表示。これ以外にも生成AIを利用した機能が提供されている

Adobe Fireflyは、どんなサービスか

Adobe Fireflyは、Adobeが2023年3月に発表した生成機能およびテキストエフェクトを中心とした生成AIモデルです。5月のベータ版リリース以来、すでに35億枚以上の画像が生成されるなど注目度も高く、発表から約6か月後の9月には、商用利用も可能な正式版となりました。

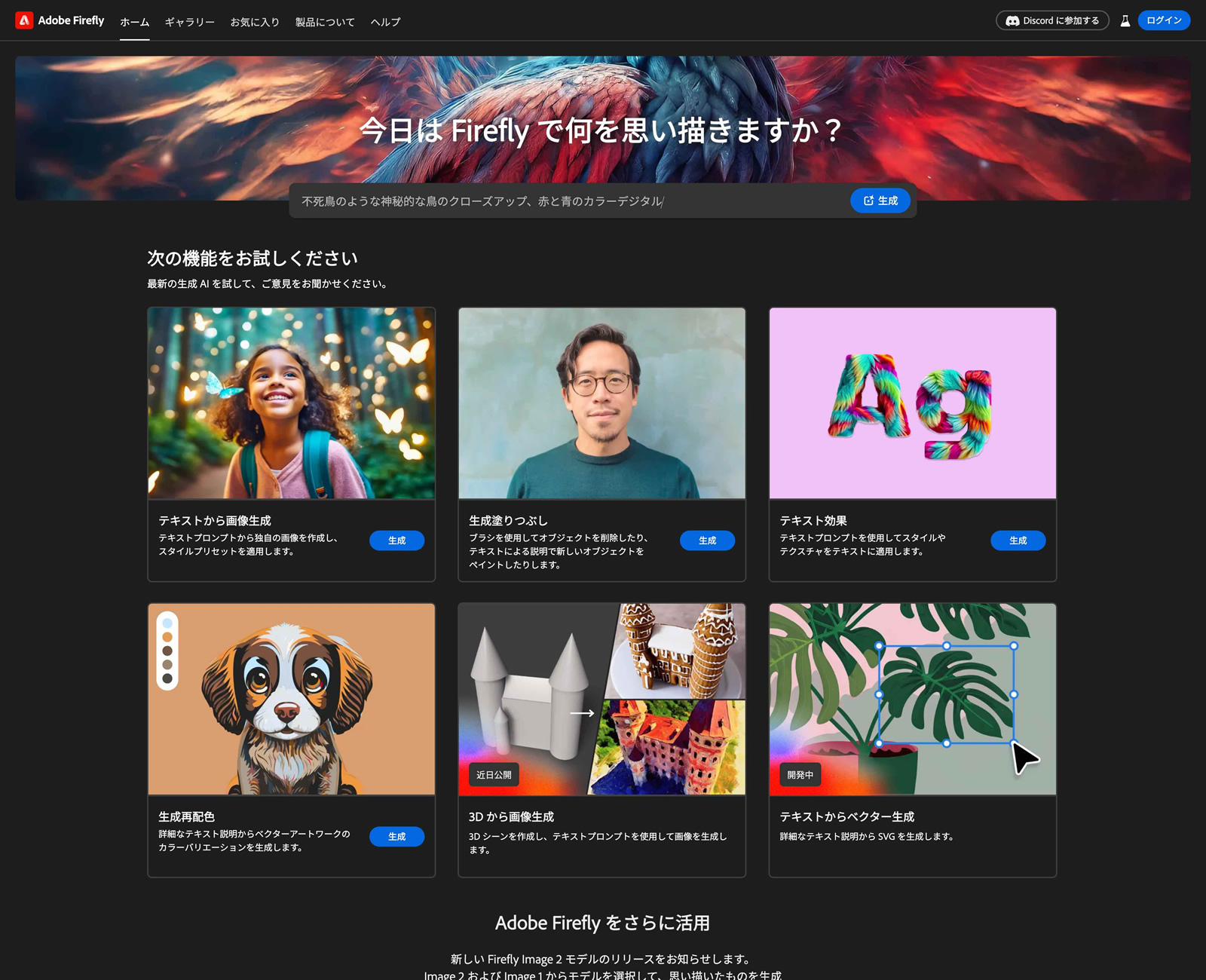

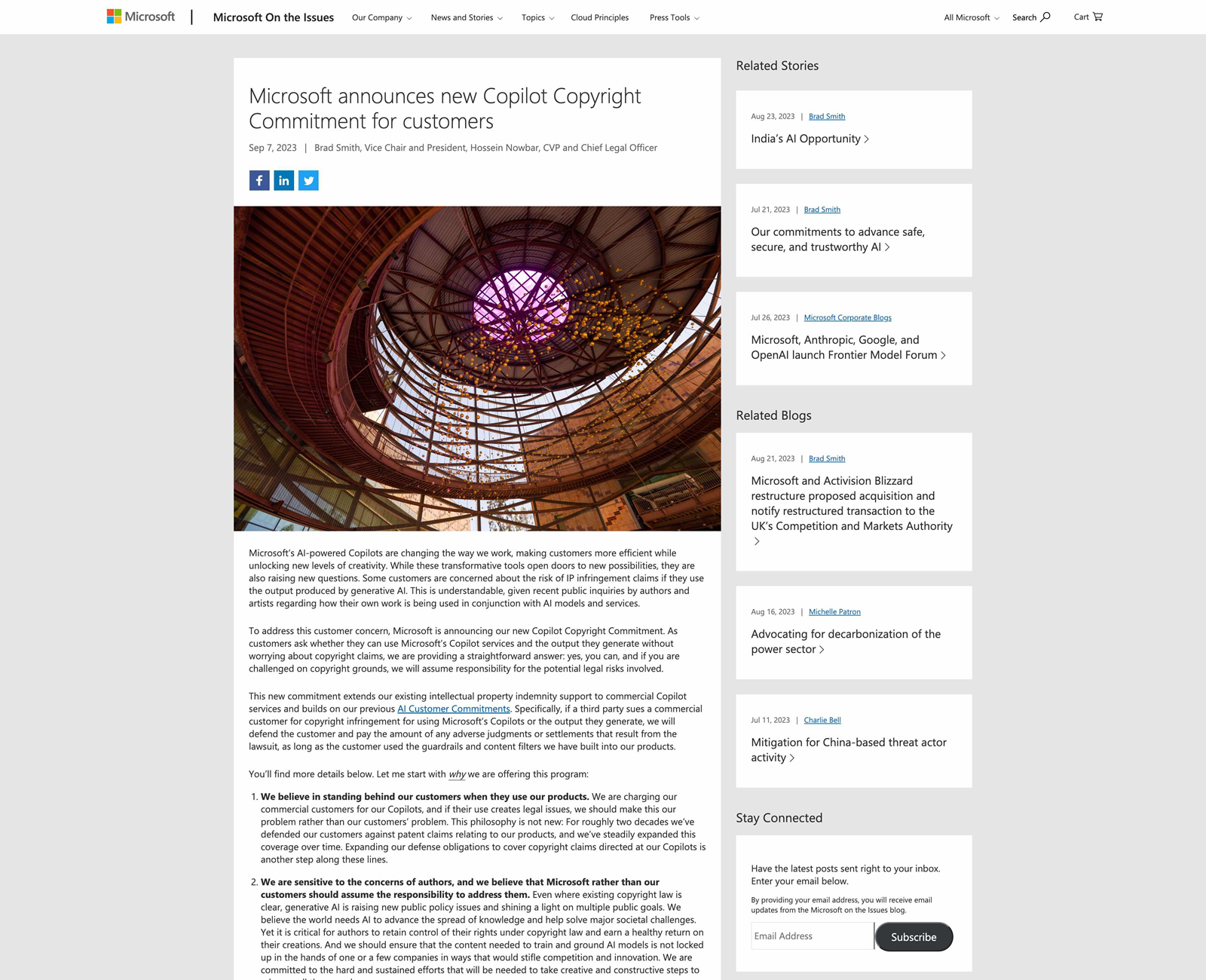

ブラウザ上でAdobe Fireflyの機能が利用できる「Adobe Firefly web版」で提供されている機能は、「テキストから画像生成」「生成塗りつぶし」「テキスト効果」「生成再配色」の4つです。今後は3Dシーンとテキストから画像を生成する「3Dから画像生成」、テキストからベクターグラフィックを生成する「テキストからベクター生成」などの機能追加も予定されています。

「Adobe Firefly web版」のトップページ。現在は「テキストから画像生成」「生成塗りつぶし」「テキスト効果」「生成再配色」の4つの機能が提供されている

Adobe Fireflyの技術は、Adobeが提供するアプリケーションでも利用可能です。Photoshopには「生成塗りつぶし」「生成拡張」、Illustratorには「テキストからベクター生成」、Adobe Expressには「生成塗りつぶし」「テキストからテンプレート生成(ベータ版)」と、各アプリケーションに最適な機能が搭載されています。

今年5月には、GoogleのチャットAI「Google Bard」上でAdobe Fireflyを使っての画像生成が可能になることも発表済みで、今後、同様のチャットAIサービスなどに広く展開される可能性もあります。

10月には、Adobe Fireflyの次世代AIモデル3種類(「Adobe Firefly Image 2 Model」「Adobe Firefly Vector Model」「Adobe Firefly Design Model」)の発表と提供が開始されました。AIによる機能の追加だけでなく、画像生成の基本となるAIモデルのアップデートも進められています。

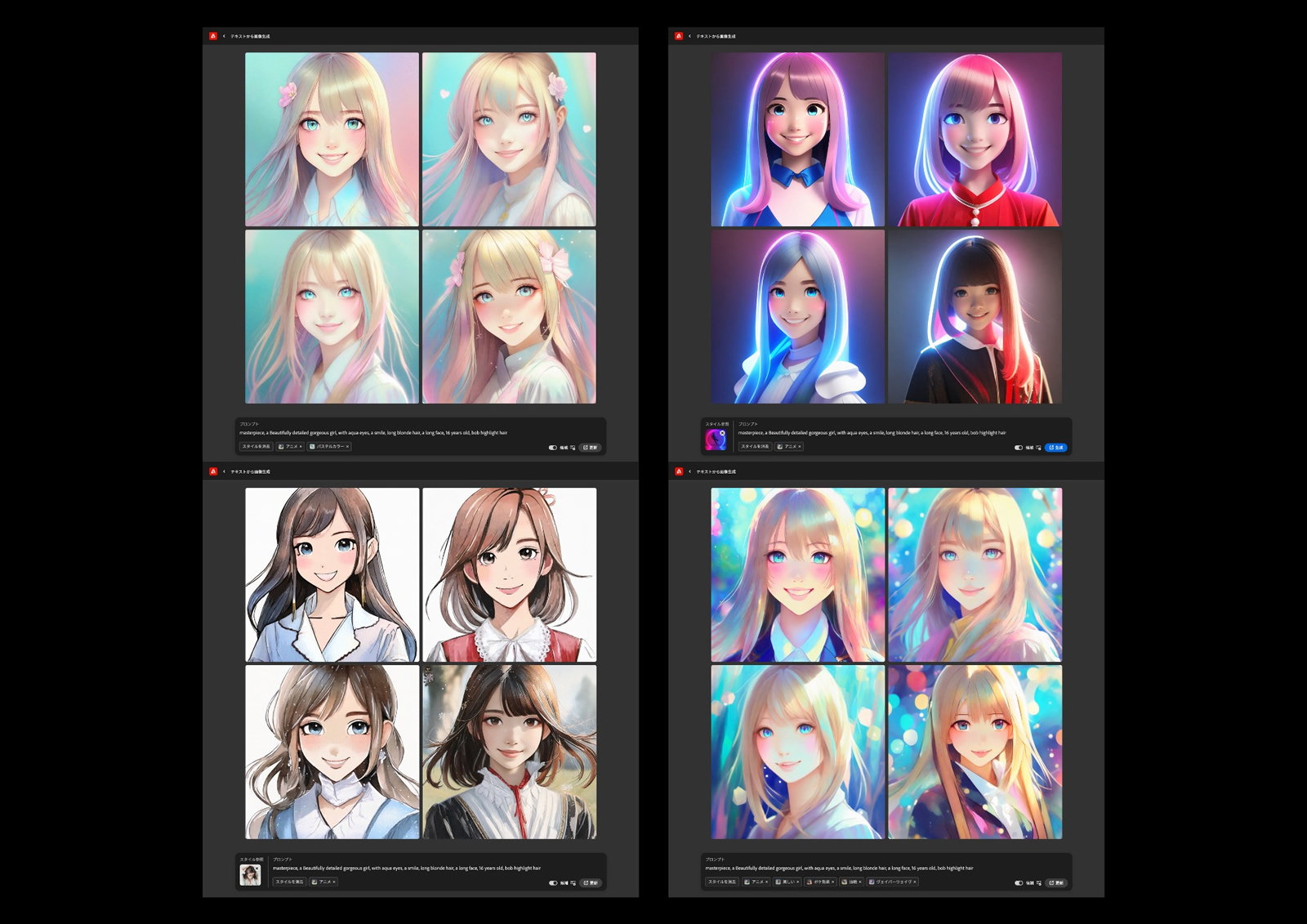

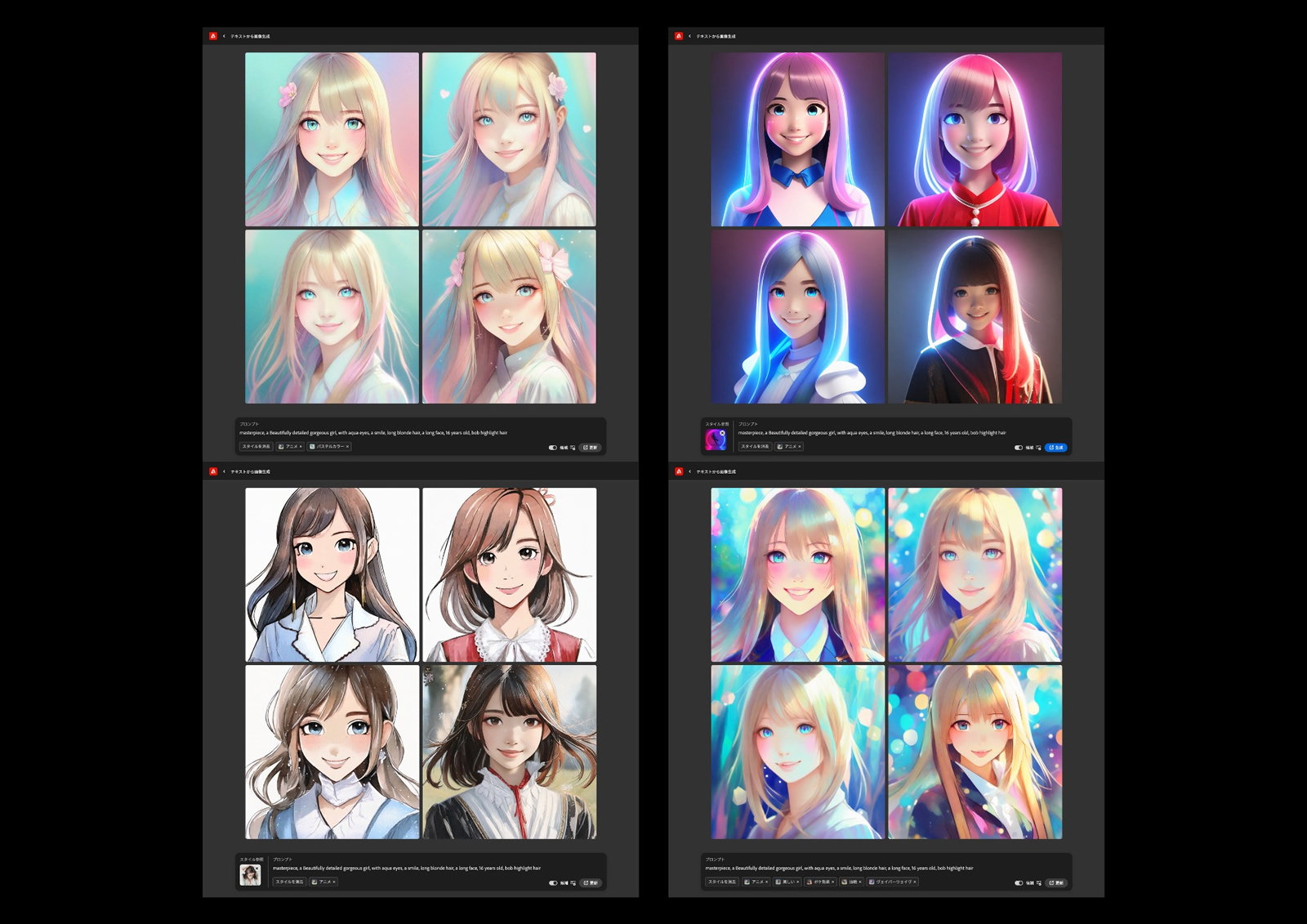

現在「Adobe Firefly web版」の「テキストから画像生成」でのみ使用可能な、最新モデル「Adobe Firefly Image 2 Model」を使った画像生成例。人物表現を改善しており、写真のようなリアルな画像作成が可能になるという

アップデートが続くAdobe Fireflyの生成機能とAdobeのアプリケーションが持つツールとしての強みを活かせば、高度でより複雑なコンテンツの制作が可能です。今後も各アプリケーションに生成AIによる機能が追加されていくことで、時間の短縮だけでなく、従来の制作フロー自体も変化することが予想されます。

Adobe Fireflyでの基本的な制作フロー

Adobe Fireflyのマニュアルでは、基本的な制作フローが説明されています。まずテキストプロンプトを変更しながら、一定レベルの出力が得られるまでAIによる生成を行い、その後Adobeのツールを使用して、完璧になるまで細部を調整していくというものです。

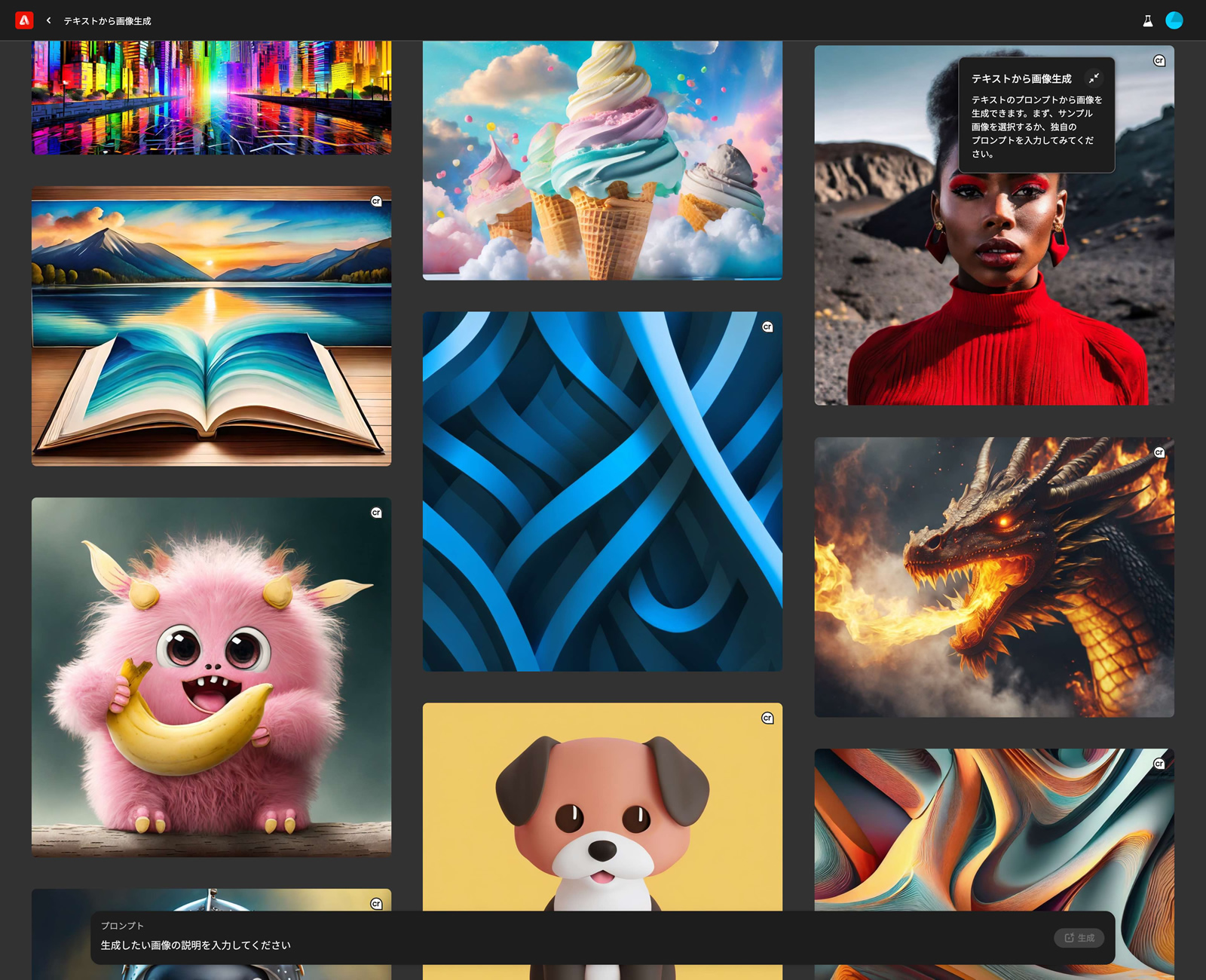

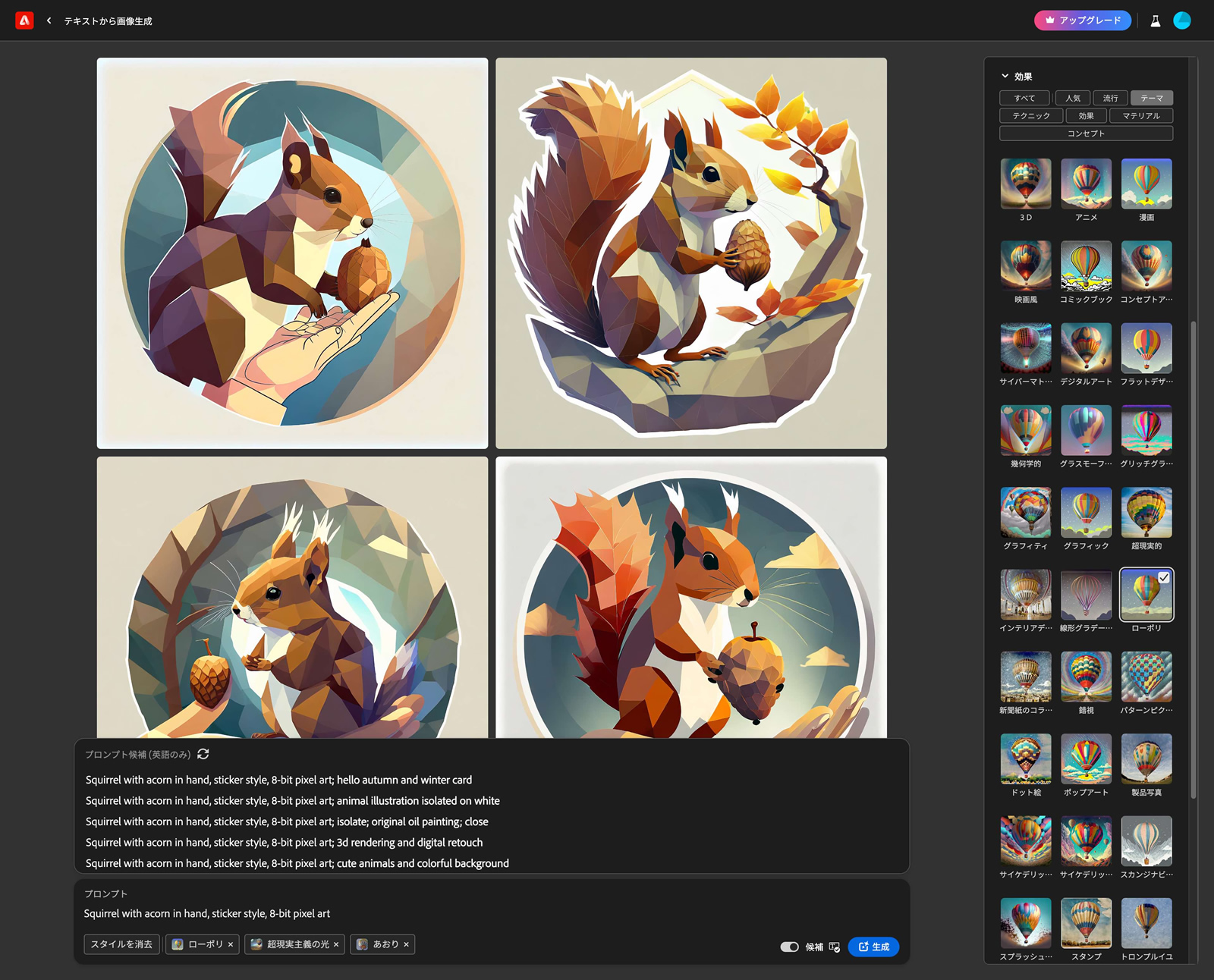

ブラウザから利用可能な「Adobe Firefly web版」を使って、基本的な画像生成機能である「テキストから画像生成」を試してみます。まず「テキストから画像生成」を選択し、テキストのプロンプトを入力するか、ギャラリーからサンプルを選択して、画像生成を開始します。

ページ下部に用意されたプロンプト入力部に、テキストを入力すれば画像生成が始まる。ギャラリーで紹介されている画像を参考にして、画像生成を開始することも可能

Adobe Fireflyで推奨される、効果的なプロンプトの記述方法は、以下のとおりです。

- プロンプトには、少なくとも3つの単語を使用

- 「生成する」や「作成する」などの単語の使用は避ける

- 主語、記述語(主語を具体的に説明する言葉)、キーワードを含む、シンプルで直接的な言葉を使用する

- 説明的にする(説明できれば、作成できる)

- 表現したいことを説明する自然な言葉を使用する

- 作品に共感をもたらす単語の使用

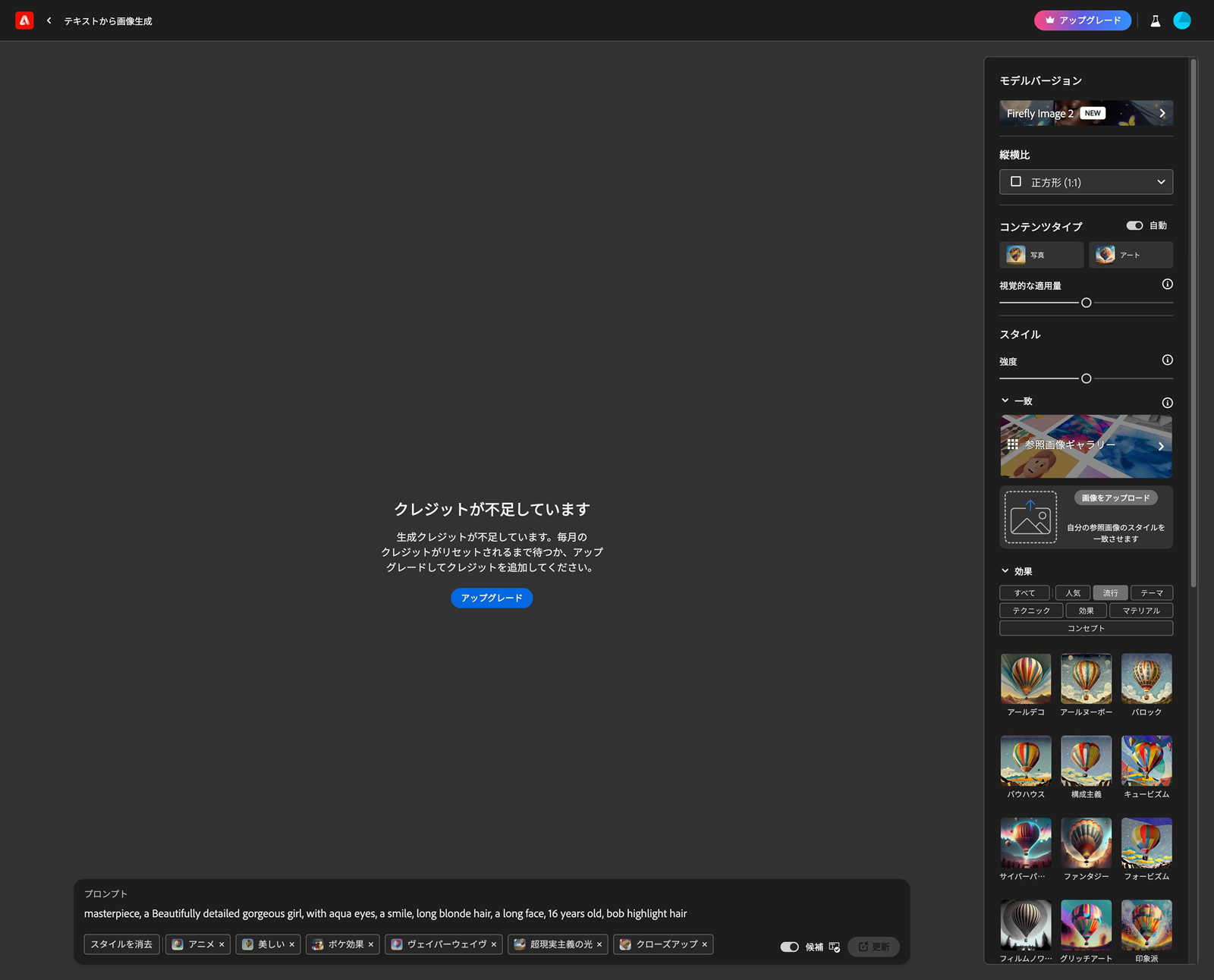

「テキストから画像生成」の基本的な画面。画面下部にはプロンプトの入力部、右側には生成画像に使用するAIモデルの選択や縦横比、効果の項目が並ぶ

画面下部にあるプロンプトの入力部にテキストを入力して、基本となる画像を生成します。

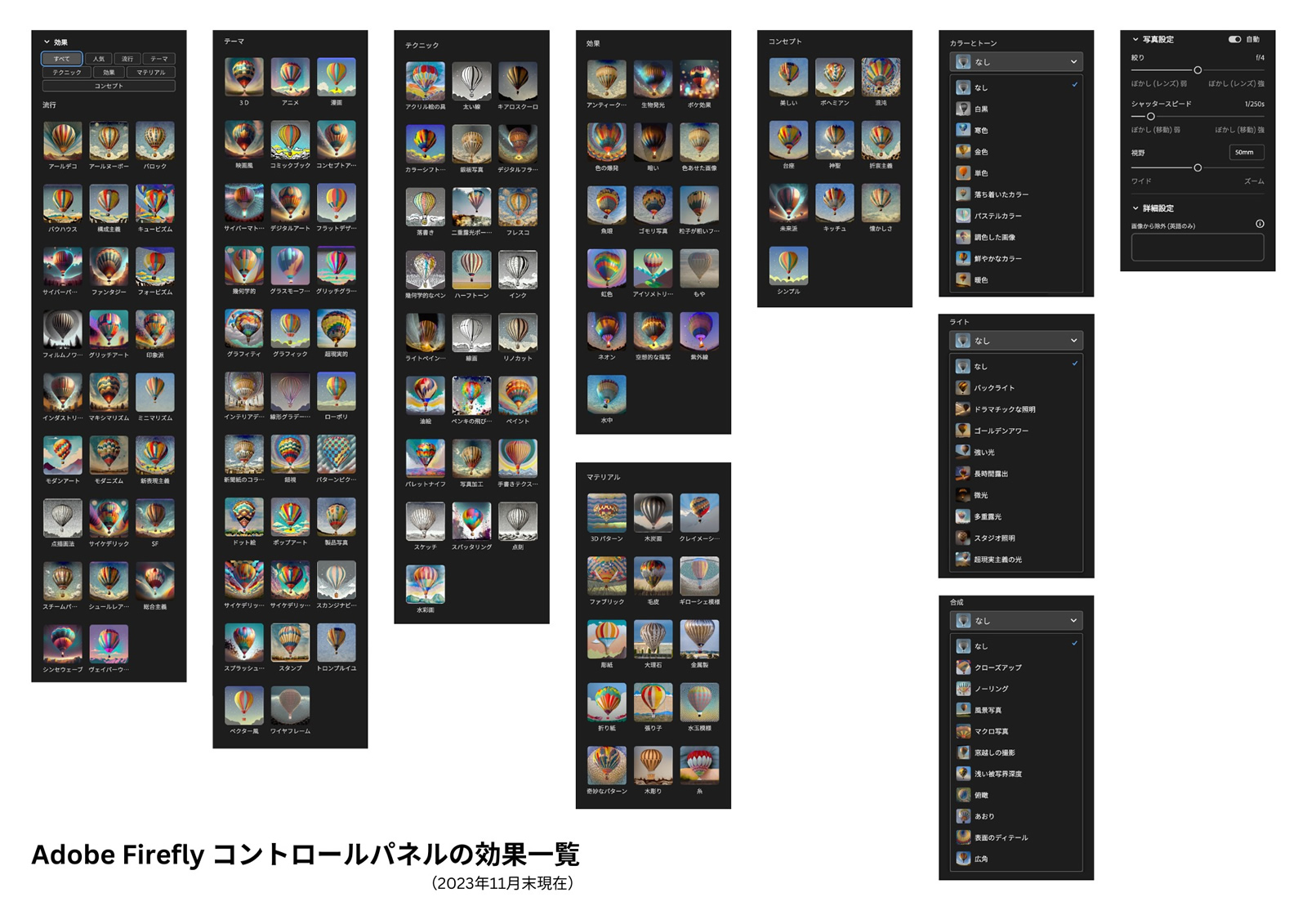

その後、Adobe Fireflyに用意されたパラメータの調整やスタイルの適用を行いながら、ほしいイメージへと画像を近づけていきます。

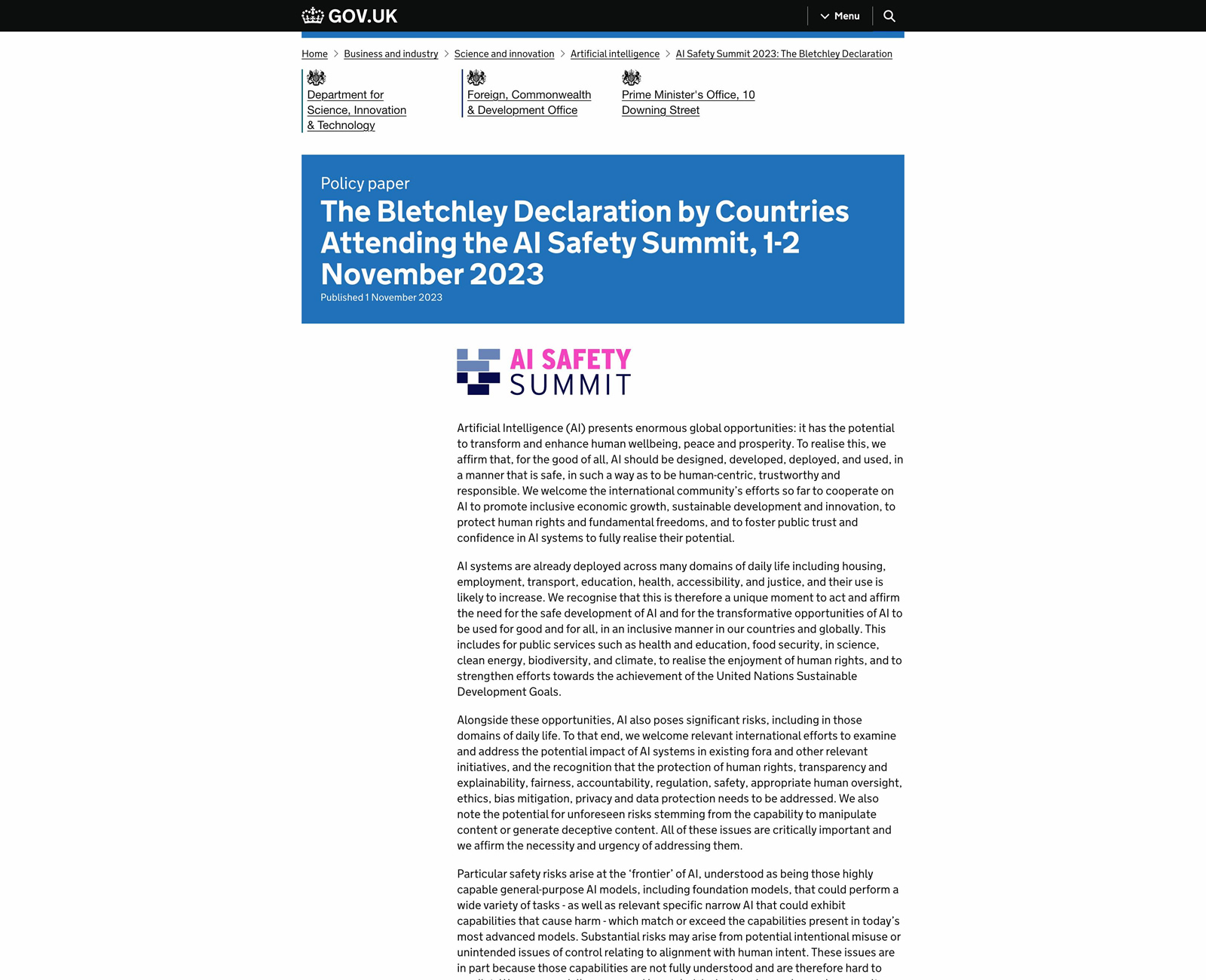

同じテキストプロンプトで、スタイルを組み替えて、生成した画像に適用した例。Adobe Fireflyに用意されたパラメータを調整したり、適用するスタイルを組み合わせて、画像の変化を確認しながら、制作したいイメージに近づけていく

画像生成AIでは、こうしたスタイルの指定は「テキストプロンプトとして入力する」場合が多いですが、Adobe Fireflyは「用意されたスタイルを選択・解除する」だけで、多彩な効果を瞬時に反映できます。基本的なイメージの方向性を決める場合、スタイルをどんどん入れ替え、組み合わせながら試行錯誤できるため、テキストプロンプトによるスタイルの書き直しがなくなり、大幅な時間短縮ができます。

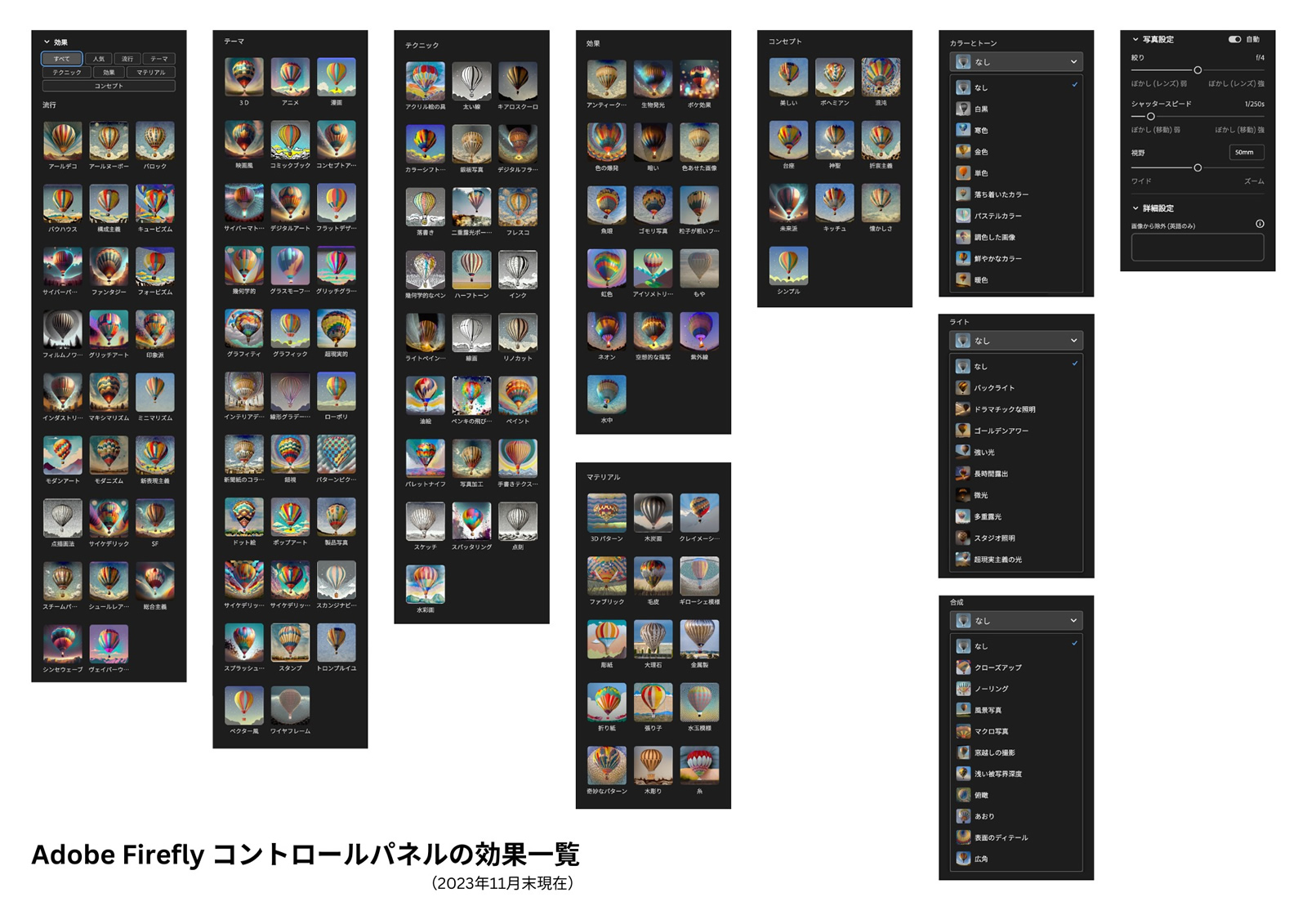

「テキストから画像生成」で設定できるスタイル効果だけでも124種類ある。画面に必要な項目はテキストプロンプトで入力し、効果は用意されたスタイルを変更しながら制作する方法が使いやすい

画像生成を悩ます「生成クレジット」問題

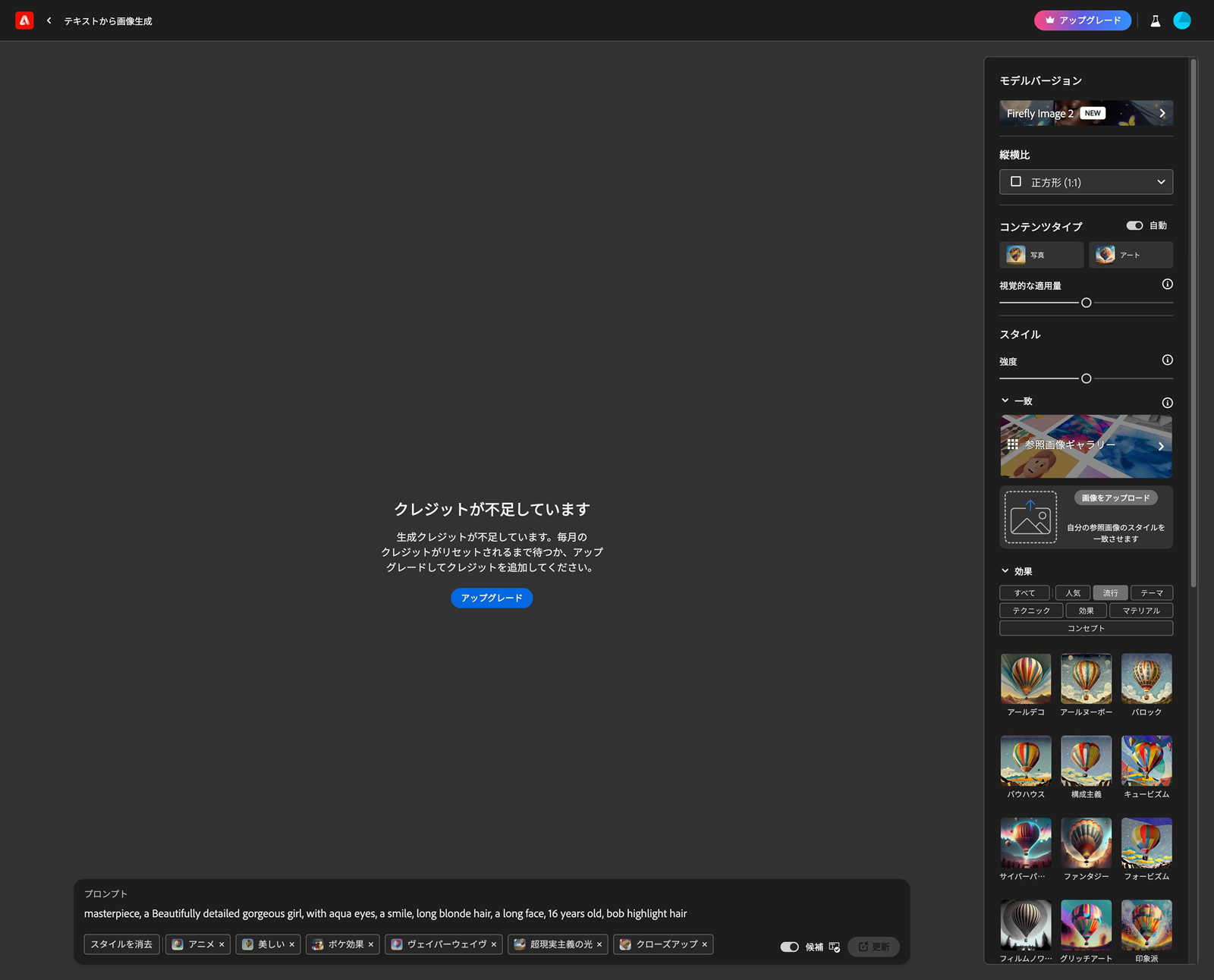

求めるイメージに近い高品質の画像を素早く生成するには、Adobe Fireflyの機能を最大限利用することが必要です。便利な機能を何度も使う場合、「生成クレジット」が必要になります。このクレジットは、AIの機能を利用するごとに消費されていきます。

「生成クレジット」は契約プランによって異なり、月間に最大1,000クレジットが付与されますが、翌月への持ち越しはできません。Adobeの「Creative Cloud」「Adobe Stock」の有料ユーザーであれば、2023年末までは無制限(処理速度の低下あり)でAdobe Fireflyの機能を利用できます。

Adobe Fireflyの「生成クレジット」を使い切るとこの画面が表示される。AIによる便利な機能を使うことで、生成クレジットが消費されていく

現状では、便利な機能を何度も使って試行錯誤を繰り返し、画像を生成・修正しながら完成させるには、圧倒的に「生成クレジット」が足りません。料金を支払えば追加で購入が可能になる予定ですが、仮に追加したとしても、完成までの作業をすべてAIの機能を使って行うのは、非常に厳しいというのが実感です。

Adobeは、解像度の高い画像やアニメーション、動画や3Dの生成を提供する予定で、これらの高度な機能に対しては、消費される生成クレジット数は増加する可能性があることを示唆しています。将来的には、画像生成AIサービスの『midjorney』が採用している、出力スピードを問わなければ、無制限に画像生成・修正が可能になるようなオプションを期待したいところです。

生成AIを取り巻く、さまざまな問題点

Adobe社が開発したAdobe fireflyを含め、生成AIを利用したサービスを使えば、簡単に高品質なコンテンツを生成できます。手軽に使えることから、多くの分野で活用される可能性が広がる一方、著作権を無視した画像の生成・利用や生成された画像の悪用など、問題点も指摘され始めています。

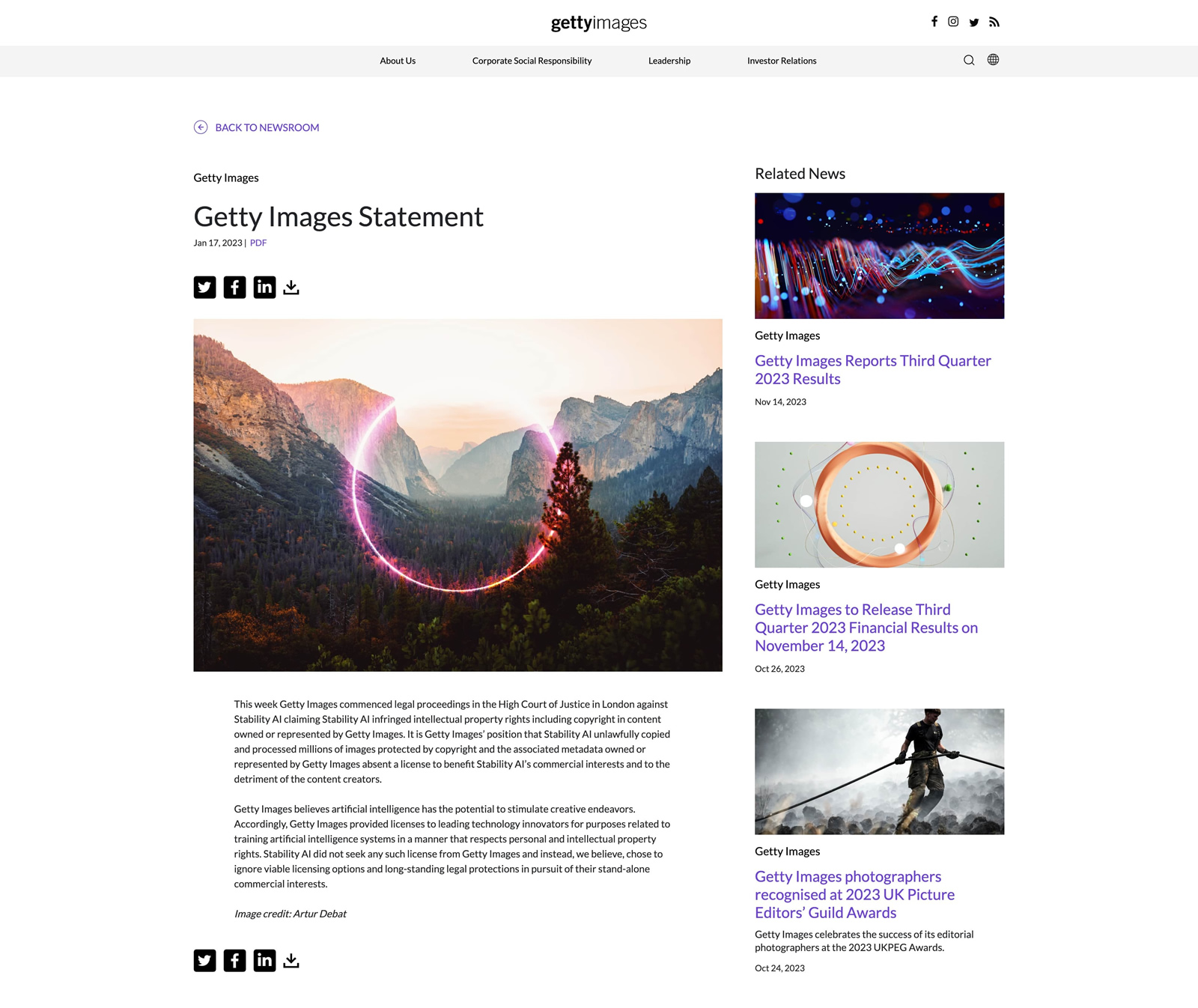

問題点1:学習データの透明性

生成AIのモデル開発には、専門家やユーザーが提供したコンテンツだけでなく、インターネット上で公開されているコンテンツも学習データとして含まれています。現時点では、あくまで学習モデルの生成が目的であれば、原則的に著作権者の許可は必要ありません。

しかし、インターネット上で公開されているコンテンツには、著作権者が無断での使用許可を認めていないもの、クレジット表記を求めているものもあります。個人情報やプライバシーに関する事柄や、偏見・差別を助長する偏りが含まれるコンテンツもあります。こうした学習データを元に、生成AIがコンテンツを生み出すことは、倫理的な問題を含んでいます。

生成AIサービスが進んでいるアメリカでは、生成AIの学習データを公開する法的義務はありません。日本の著作権法30条の4でも、学習データとして収集する場合、「著作権者の利益を不当に害する場合を除き、著作権を侵害しない」と規定されています。そのため各生成AIサービスでは、学習データは非公開、または最低限の公開となっています。

一方で、生成AIの利用者には「学習データが生成したコンテンツにどんな影響を与えているか」という疑問が、コンテンツ制作者には「自身の作品が許可なく利用されているのではないか」という不安が存在します。現状では、生成AIが利用者やコンテンツ制作者からの不信感を払拭するのは難しいでしょう。

ストックフォトサービスのGetty Imagesによる報道発表。Getty Imagesは、画像生成AI「Stable Diffusion」が、モデルの学習にGetty Images保有の1,200万枚以上の画像を無許可で利用していたとして、開発したStability AIを著作権侵害で提訴。米国著作権連盟に提出された訴状では、「当社の知的財産権を、驚異的な規模で堂々と侵害した」と非難している

問題点2:著作権侵害や、悪用による社会への影響

さまざまな著作物を学習データとして利用している生成AIでは、生成されたコンテンツが著作権の侵害を引き起こす可能性があります。また、宗教や人種、特定の個人やグループへの偏見を反映していないかといった、倫理的な配慮も必要です。そのため、生成されたコンテンツを使用する際には、既存の著作物の権利を侵害していないか、倫理的な問題を含んでいないかの確認が必要不可欠です。

近年では、AIを利用して作った偽の画像や動画、「ディープフェイク」の技術が大幅に向上しています。画像や動画、音声などを結合して、実際には行っていない動作や話していない言葉を事実のように見せかけるコンテンツは、SNSなどを利用して拡散され、社会の混乱を引き起こす可能性もあります。

注意深く確認すれば、偽物だと判断できるコンテンツがまだ多いものの、技術の進化で、本物かどうかの判断が難しくなる可能性が高まっています。判別が困難となれば、誤った情報にだまされる危険も増えます。日本でも政治家のなりすましなど、実際に悪用する事例も発生していることから、社会的な対応が必要になり始めています。

問題点3:AIが生成したコンテンツの著作権

生成AIでは、プロンプトを指定するだけで、誰でも簡単に大量のコンテンツが作成できます。そのため生成AIで作成したコンテンツについては、「著作権を認めるのはおかしい」との意見もあります。

2023年5月、文化庁はAIと著作権の関係に関する説明資料「AIと著作権」を公開しました。資料ではAIと著作権の関係に関して、「AI開発・学習段階」「生成・利用段階」「AI生成物が著作物に当たるか」に分けて、著作権法における解釈を説明しています。

日本の著作権法では、「簡単な指示などでAIが自律的に生成したものは、著作物に該当しない」と判断しています。ただし創作表現のため、「AIを道具として使用した」と認められれば、著作物に該当し、AIの利用者が著作者となりえます。

「AIを道具として使用したかどうか」の判断は、人の創作意図(思想または感情を表現したものを創作する意図)の存在、人による創作的寄与行為(思想または感情を創作的に表現するための必要な処理・選択などの一連の行為)を行ったかで、個別に判断されます。

アメリカでは、生成AIで作られたコンテンツに著作権を認めるかについては、すでに複数の判例が出ています。アメリカの著作権法における争点は、生成AIで制作されたコンテンツに「人間の創作性が認められるか」という点です。日本の場合と同様に、創作性については個別の判断となるため、判例もまちまちです。

アメリカのコンテストで優勝して話題となったAI生成の絵画、Jason M. Allenの『Théâtre D’opéra Spatial』。画像生成AIサービスの『Midjourney』で少なくとも624回のテキストプロンプトの入力、Adobe Photoshopでの修正、画像の高解像度化を行ったと説明。米国著作権局は、『Midjourney』がプロンプトを表現創造の具体的な指示として解釈していないとして、生成した画像部分について著作物性を認めず

現時点では、生成AIによる制作物に関して、人間の創作性の有無を判断する一定の基準はありません。コンテンツを生み出す場合、制作過程でどのような作業を行い、どのような影響があったのかを個別に判断されることになります。創作性を証明する一定の基準や方法がないため、AIを利用する制作側にとっては、著作物の認定に関する不安が存在しています。

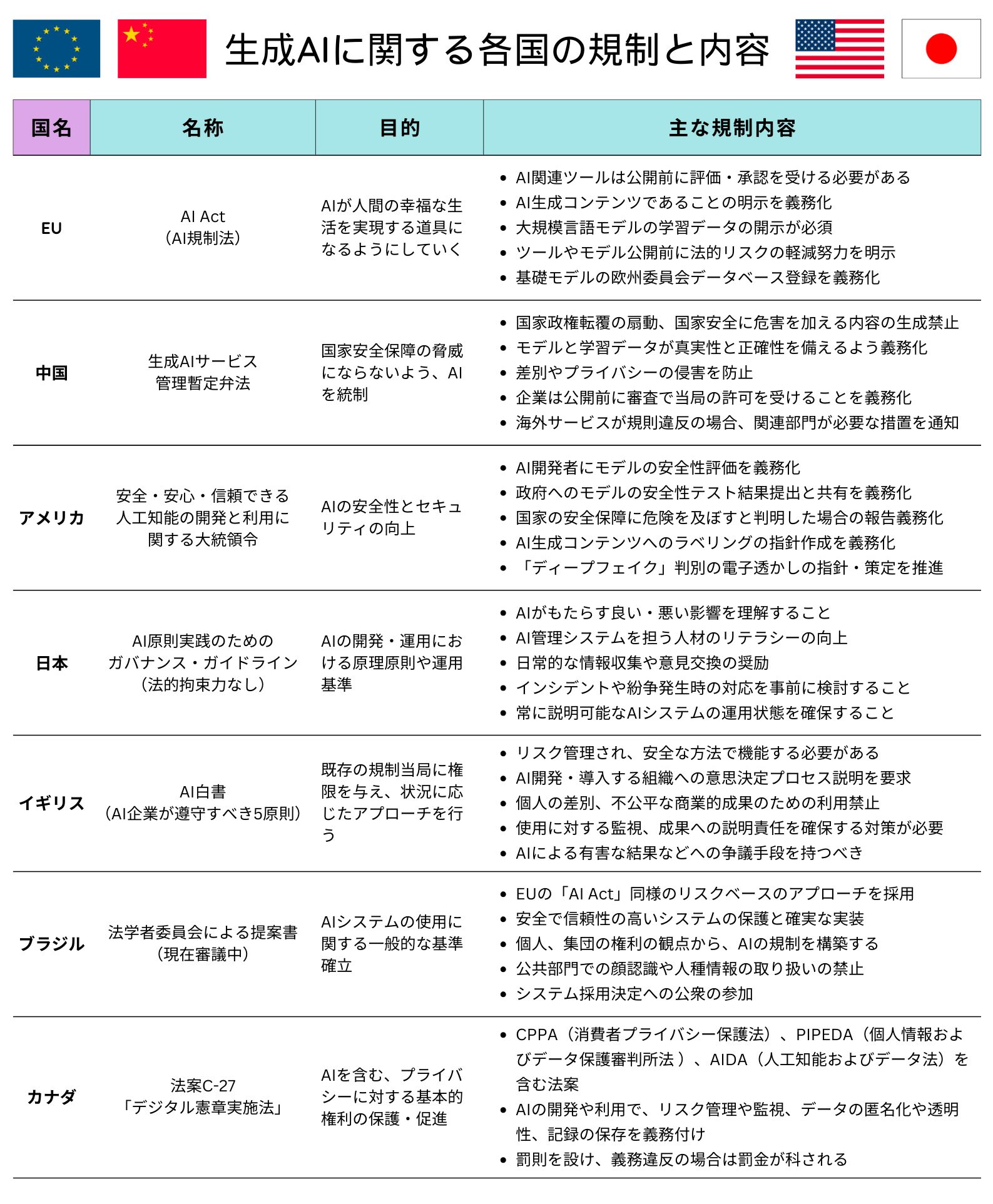

生成AIに対する各国の規制とその対策

今年3月、イタリア政府はEUの個人情報保護法であるGDPR(一般データ保護規則)に抵触する疑いがあるという理由で「ChatGPT」の利用を禁止しました。さらにイタリア人ユーザーのデータ利用を禁止するよう、「ChatGPT」の開発元であるOpenAIに命令を出しました。

GDPRは、個人情報を収集・利用する場合には、企業が各個人の合意を得ることを義務付けている法律です。OpenAIは、AIモデルに学習させる場合の個人情報がどう使われるのかの開示や、オンラインで個人情報利用のオプトアウトを可能するなどの対応措置を実行して、4月末にはイタリア政府が禁止を解除しました。

生成AIの利活用が世界に広がるにつれ、各国の持つ法律や文化、倫理観などの違いから派生した問題点も生じています。このため、世界各国では生成AIへの規制や法整備が検討されています。

EUの場合

EU(欧州連合)では、今年6月に加盟国からなる欧州委員会で、生成AIを含む包括的なAI規制案「AI Act(AI規制法)」が採択されました。AIの利用は人間の自律性や自由が守られるべき範囲で行われる必要があるとした、人権や自由の確保をベースにした規制案で、2025年の施行を予定しています。

中国の場合

中国は、真っ先に生成AIに関する規制を導入しています。今年8月には「生成AIサービス管理暫定弁法」を施行。“社会主義の核心的価値観の堅持”から、生成AIが国家の安全保障の脅威にならないようにすることが目的で、知的財産権や個人情報の保護、虚偽情報の流通や差別などを禁止しています。「真実性」と「正確性」を備えることを義務化しており、事実上、海外の生成AIモデルは、中国国内で運用できないとみられています。

アメリカの場合

アメリカでは、一部の州で法制化が進んでいるものの、法令遵守の難しさから国家レベルでの法制化が進められています。7月に大統領が国内でAIサービスを提供する企業の経営陣と会談し、AIの安全性や透明性を確保するためのルール導入で合意。10月には、法的拘束力を持った主要8項目からなる「安全・安心・信頼できる人工知能の開発と利用に関する大統領令」を発令しています。利用者の安全性確保やプライバシー保護を重視しており、労働市場に与える影響調査や、AIサービス提供前に政府による安全性評価を受けることなどを義務付けています。

日本の場合

日本では、経済産業省がまとめた「AI原則実践のためのガバナンス・ガイドライン」が公表されています。AIの開発・運用に関わる企業の原理原則や運用基準であるため、法的な拘束力はありません。現在では、この指針を遵守させる措置の検討がようやく始まった段階です。経済成長戦略の柱としてAIの利活用を掲げ、規制範囲を慎重に定めるべきとしている日本では、AIの規制は先進国の中でもっとも緩いです。

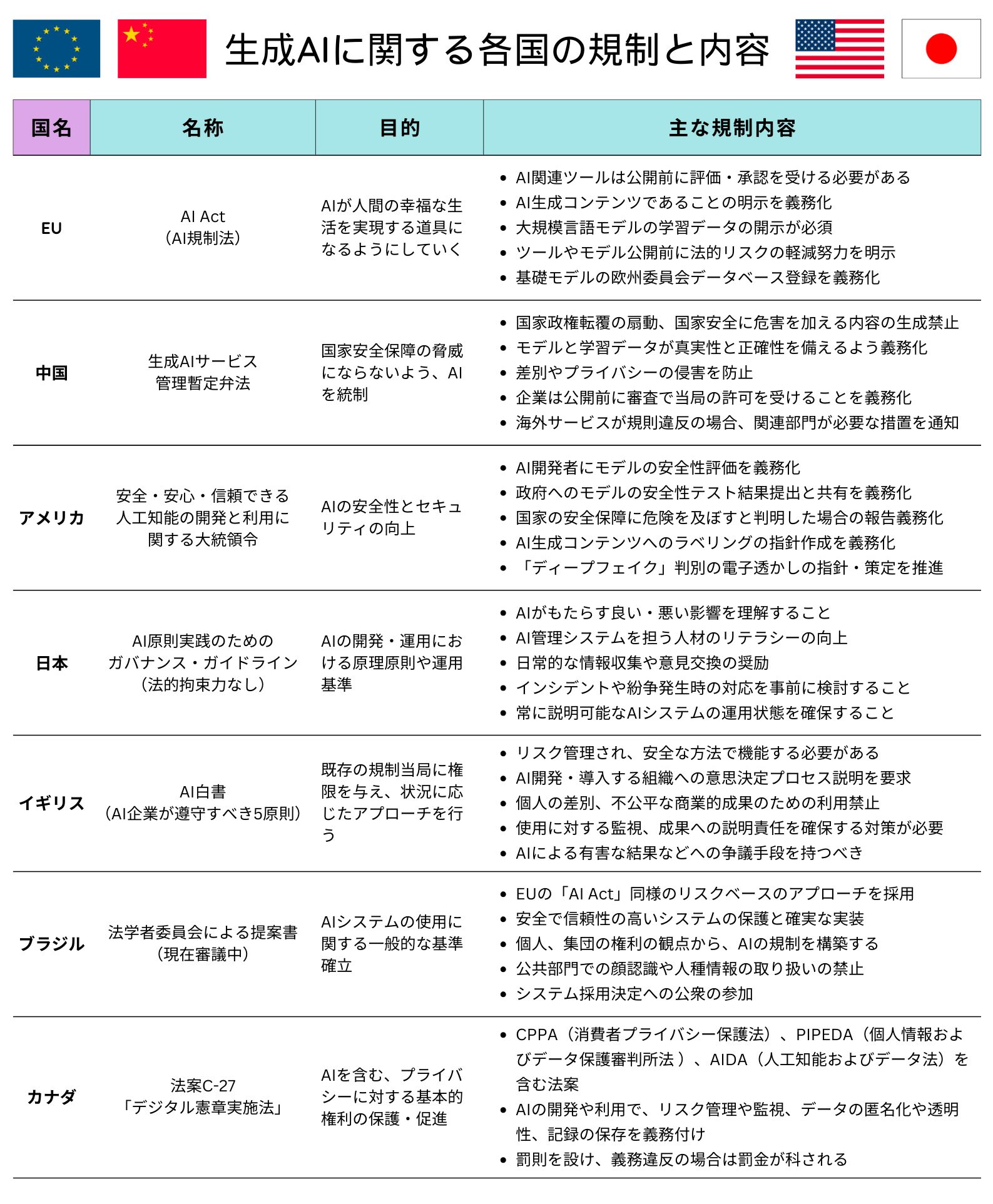

世界各国の生成AIに関する規制とその内容をまとめたもの

生成AIが社会に普及するには、何が必要か

大きな進歩を遂げてきた生成AIは、多くの分野で活用され始めています。しかし、これまで説明したように問題点もあります。こうした点を踏まえた上で、生成AIが一般に普及するには何が必要なのでしょうか。

まず、生成AIの利用に関する法的なルールや倫理的なガイドラインの策定が挙げられます。生成AIによるコンテンツの著作権や責任の所在を明確にすることで、生成AIの利用者や権利を保護できます。また悪用されないよう、利用に関する監視や規制を行うことで、生成AIの安全性や公正性も確保できます。

11月にイギリスで開催された「AI(人工知能)安全サミット」では、29の国と地域による共同宣言「AI安全に関するブレッチリー宣言」を公表。AIから生じるリスクなどに、国際協力で対応することが最適としている

生成AIの開発や提供に関わる企業や組織が、生成AIの安全性に配慮したサービスを提供することも必要です。なかでも学習データの公開は、生成AIの利用に関する開発者側と利用者、コンテンツを生み出すクリエイター側との信頼を高められます。生成AIが作ったコンテンツの出典や根拠の明示も必要です。

Adobeが提示する、生成AIに関する「クリエイターファースト」のメッセージ。Adobe Fireflyは独自開発したAIモデルで、問題のないコンテンツを生成するよう、著作権や商標などの管理を行う。学習データには許可済み、著作権切れのデータだけを使用。デジタル認証を通じてコンテンツ作者の権利を守るCAI(Content Authenticity Initiative)も主導している

企業や組織では、コンプライアンスの観点からも、生成AIの利用に関するリスクの最小化が求められます。こうした要望から、コンテンツの著作権や問題発生時の責任など、問題発生時の補償をサービスに含める法人向けサービスも登場しています。利用者側のリスクへの保証は、これから必須となることでしょう。

マイクロソフトは、生成AIによる出力を使用した場合の知的財産権の侵害訴訟などに備えた「Copilot Copyright Commitment」を発表。第三者が著作権侵害で顧客を訴えた場合、マイクロソフトが顧客の弁護や訴訟で生じた判決・和解による金銭の支払いを保証する。顧客が法的なリスクを気にすることなく、サービスを利用できる環境を整えている

最後に、生成AIの利用者や開発者による責任ある行動が必要です。著作権を侵害しないための知識や生成されたコンテンツの真偽や価値を判断できる能力を持つこと、コンテンツが与える影響や責任を認識することはもちろん、社会的に受け入れられるコンテンツを生成していくことで、生成AIに対する信頼も向上します。

生成AIが社会に普及するには、安心して利用できる仕組みづくりが重要になると言えます。誰もが利用できる仕組みの構築とリスクに対する補償の明確化、そして利用者の責任ある行動で、生成AIは人間の創造性を拡張する可能性を秘めています。今後も発生するであろう問題点への対応は必要ですが、生成AIは社会にとって有益かつ、必要不可欠な技術となっていくはずです。