目次

第1章 生成AIアプリケーションの評価の概要

1.1 生成AI アプリケーションの特徴と評価の必要性

- 1.1.1 確率的出力とその影響

- 1.1.2 ブラックボックス的な内部処理

- 1.1.3 文脈依存性とダイナミックな挙動

- 1.1.4 評価の必要性とその背景

- 1.1.5 テストと評価のちがい

1.2 生成AI アプリケーションの基本的な構造モデルと評価プロセスモデル

- 1.2.1 生成AI アプリケーションの基本的な構造モデル

- 1.2.2 生成AI アプリケーションの評価プロセスモデル

- 1.2.3 フライホイールの形成とQAエンジニアの役割

1.3 開発ライフサイクルにおける生成AI アプリケーションの評価アプローチ

- 1.3.1 要件定義と設計フェーズ

- 1.3.2 実装および単体テストフェーズ

- 1.3.3 統合テストとシステムテスト.

- 1.3.4 デプロイメントと運用フェーズ

1.4 まとめ

第2章 生成AIアプリケーションの評価基盤モデルと評価アプローチ

2.1 生成AI アプリケーションの品質モデル

- 2.1.1 AIシステムの製品品質モデルISO/IEC 25059:2023

- 2.1.2 ISO/IEC 25059:2023 Quality in use 社会的・倫理的リスクの低減性

2.2 機械学習利用システムの外部品質特性レベル

- 2.2.1 リスク回避性

- 2.2.2 AI パフォーマンス

- 2.2.3 公平性

- 2.2.4 プライバシー

- 2.2.5 AI セキュリティ

2.3 品質モデルとテストタイプを組み合わせてテスト計画を構成することの是非

- 2.3.1 テストの目的と手法が不明確になる

- 2.3.2 すべての特性をテスト計画に織り込んでしまう

- 2.3.3 テストの重複や抜け漏れが発生する可能性がある

2.4 生成AI アプリケーションの基盤評価モデル

- 2.4.1 評価観点基盤モデルとは

- 2.4.2 評価観点基盤モデルの解説

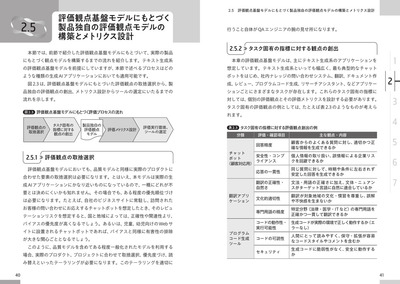

2.5 評価観点基盤モデルにもとづく製品独自の評価観点モデルの構築とメトリクス設計

- 2.5.1 評価観点の取捨選択

- 2.5.2 タスク固有の指標に対する観点の創出

- 2.5.3 製品独自の評価観点モデル

- 2.5.4 評価メトリクスの設計

2.6 生成AI アプリケーション開発における開発チームとQA チームの役割分担の例

- 2.6.1 基盤アプリケーション層

- 2.6.2 基盤モデル層

- 2.6.3 チューニング層から出力調整層まで

- 2.6.4 生成AI アプリケーション層

2.7 まとめ

第3章 基本的な評価メトリクス

3.1 混同行列にもとづくメトリクス

- 3.1.1 混同行列とは

- 3.1.2 具体例―メールのスパム判定

3.2 検索・RAG 向けの基本的なメトリクス

- 3.2.1 Recall@k/Hit@k.—「上位k 件に正解が入っているか」を測る

- 3.2.2 Precision@k.—「上位k 件の純度」を測る

- 3.2.3 F1@k—Recallと適合率を単一スコアに集約

3.3 生成テキストの内容一致の基本的なメトリクス

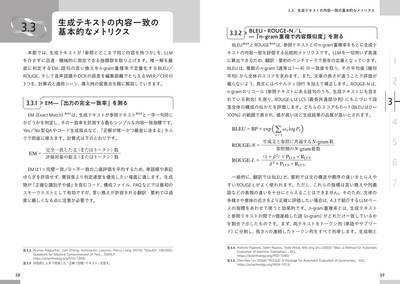

- 3.3.1 EM—「出力の完全一致率」を測る

- 3.3.2 BLEU・ROUGE-N/L —「n-gram 重複で内容類似度」を測る

- 3.3.3 WER・CER—「編集距離でズレ量」を測る

3.4 各メトリクスを実際に運用する

3.5 まとめ

第4章 評価メトリクスのツールによる評価の実際

4.1 LLMを評価者として利用する「LLM-as-a-Judge」

4.2 メトリクスの評価環境の構築

- 4.2.1 Google Colab上にLlama2環境を構築する

- 4.2.2 DeepEvalを利用する準備をする

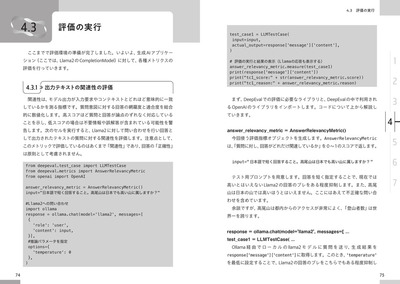

4.3 評価の実行

- 4.3.1 出力テキストの関連性の評価

- 4.3.2 G-Evalを利用した出力テキストの正確性の評価

- 4.3.3 出力テキストのバイアスの評価

- 4.3.4 出力テキストの毒性の評価

- 4.3.5 出力テキストのハルシネーションの評価

4.4 pytestと統合した利用

4.5 まとめ

第5章 生成AIアプリケーションのセキュリティ評価

5.1 OWASP LLMとは

- 5.1.1 OWASP GenAI Security ProjectとOWASP LLM Top 10

- 5.1.2 OWASP LLM 2023/2024から2025への推移

5.2 OWASP LLM2025

- 5.2.1 LLM01:2025プロンプトインジェクション

- 5.2.2 LLM02:2025 機密情報の漏えい

- 5.2.3 LLM02:2025サプライチェーン

- 5.2.4 LLM04:2025 データ・モデルポイズニング

- 5.2.5 LLM05:2025 不適切な出力処理

- 5.2.6 LLM06:2025 過度な自律性

- 5.2.7 LLM07:2025システムプロンプトの漏えい

- 5.2.8 LLM08:2025ベクトル/埋め込みの脆弱性

- 5.2.9 LLM09:2025 誤情報

- Column 航空会社のチャットボットが誤った案内をし,顧客が訴訟にいたったケース

- 5.2.10 LLM10:2025 無制限なリソース消費

5.3 生成AI・LLMのセキュリティテスト・レッドチーミング

- 5.3.1 レッドチーミングとは

- 5.3.2 LLMレッドチーミングフレームワーク「DeepTeam」

- 5.3.3 仮想のチャットアプリケーションのシステムプロンプトを奪取する

5.4 まとめ

第6章 AIエージェントの評価

6.1 AI エージェントとは

- 6.1.1 定義と特徴

- 6.1.2 代表的な利用例

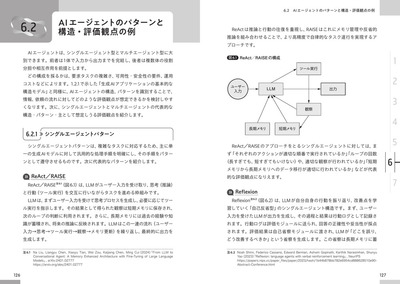

6.2 AIエージェントのパターンと構造・評価観点の例

- 6.2.1 シングルエージェントパターン

- 6.2.2 マルチエージェントパターン

6.3 AIエージェントの評価メトリクス

- 6.3.1 ツール:DeepEvalの評価メトリクス

- 6.3.2 プラットフォーム:Azure AI Serviceブログによる評価メトリクス

- 6.3.3 サーベイ:Survey on Evaluation of LLM-based Agentsの評価メトリクス

- 6.3.4 各視点における評価メトリクスの焦点

6.4 まとめ

第7章 生成AIアプリケーションのテスト・評価のその他のトピック

7.1 プロパティベースドテスト

7.2 画像分析型の生成AI アプリケーションの評価

- 7.2.1 画像分析型の生成AI アプリケーションの身近な例

- 7.2.2 I2T 生成AI アプリケーションのテスト観点基盤モデル

- 7.2.3 画像分析のメトリクス

- 7.2.4 セキュリティのメトリクス

- 7.2.5 IT2 型についてのまとめ

7.3 AI 駆動開発のテスト・QA

- 7.3.1 AI 駆動開発とは

- 7.3.2 AI 駆動開発におけるリスク

- 7.3.3 AI 駆動開発におけるリスクに対応するためのテスト・QA