今回はAIアシスタントのWitsyを紹介します。

AIアシスタントは便利

第905回などをはじめとする過去の記事ではLLMのクライアントはWebブラウザーを前提としています。なにせ手軽であることが大きな理由ですが、LM Studioを例に出すまでもなく、専用のクライアントアプリがあったらいろいろ便利です。だったらLM Studioを使用すればいいのですが、クローズドソースなのであまり使用したくありません。

そんなときに次の候補にしたいのが、第883回でも簡単に紹介したWitsyです。LLM管理機能こそはありませんが、多くのクラウドLLMサービスに対応しているばかりでなく、ローカルLLMにも対応しています。対応するローカルLLM実行環境はLM StudioとOllamaですが、LM Studioのバックエンドはllama.

Witsyは少し前のバージョンまでフォーカスに関する不具合があっておすすめしづらかったのですが、現在はそれも解消され、広くおすすめできる存在になっています。ただ、IBusで若干もたつくような挙動はあります。

動作環境

今回使用するのは第905回で紹介した、NVIDIA GeForce RTX 5060 Tiを使用したPCです。モデルはQwen3.

ダウンロードとインストール

WitsyはDebパッケージとして提供されています。GitHubのReleasesページから

初期設定

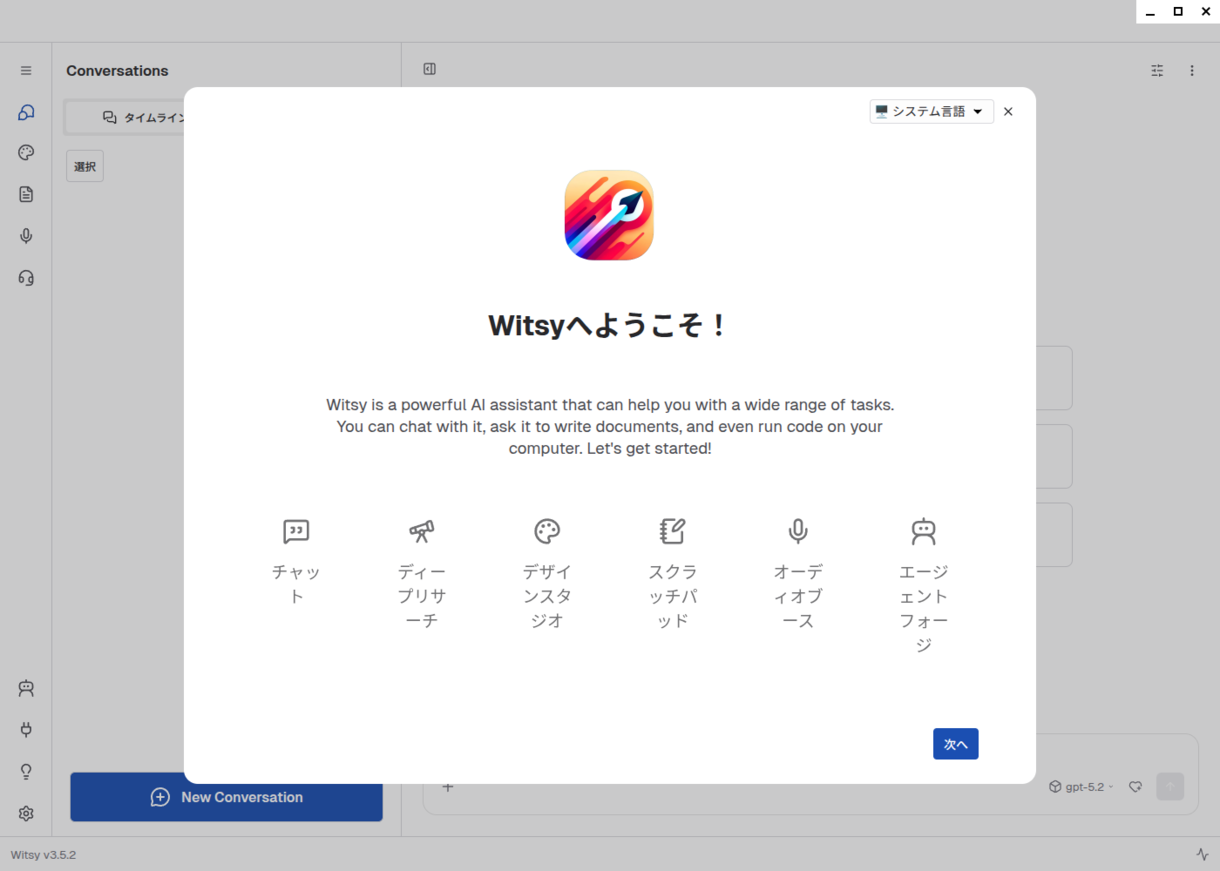

最初起動した際にウィザードが表示されます

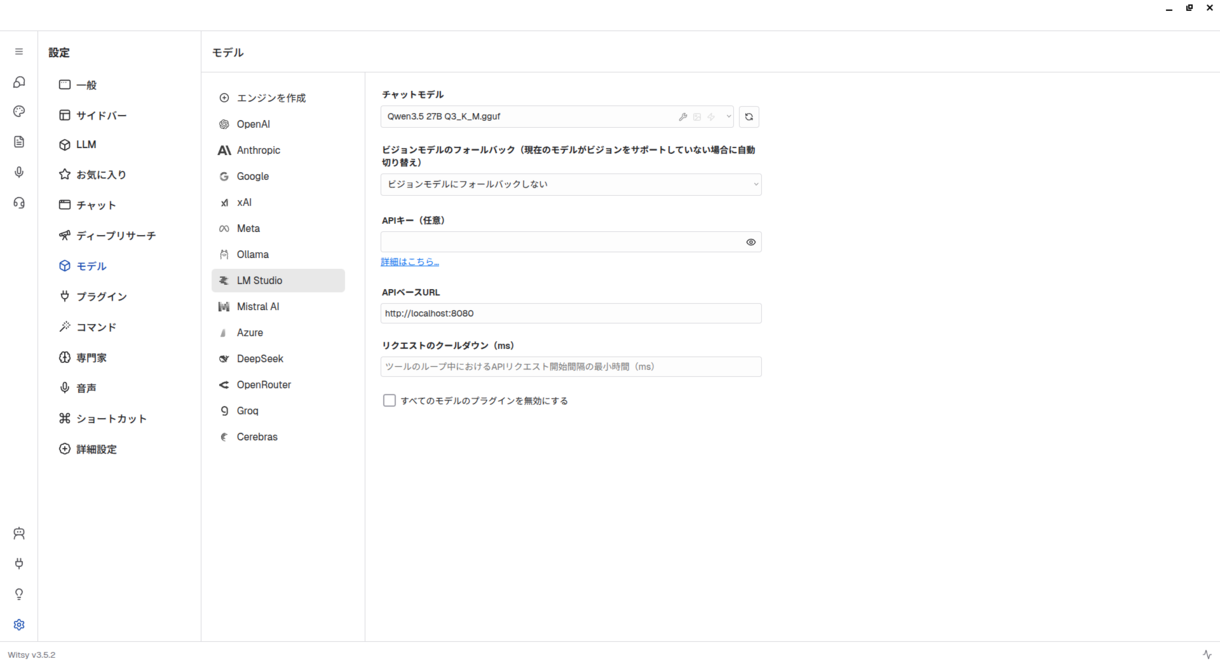

最低限必要な設定としては使用するLLMを選択することです。サイドバー左下の歯車アイコンをクリックして設定画面を表示し、

多くのLLMクラウドサービスに対応していることがわかりますが、ここでは

「APIベースURL」

これで設定完了です。

「チャット」

デフォルトでは

基本的な使い方

サイドバーの上から2番目の

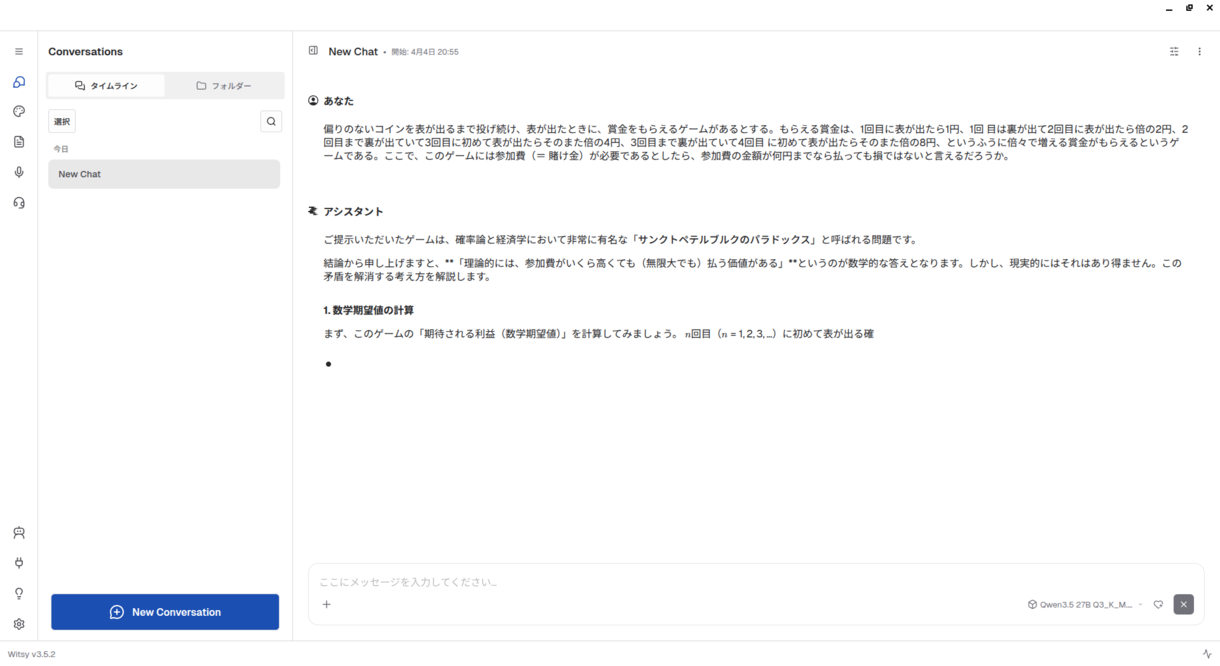

なにか質問してみてください

Witsyの便利なところ

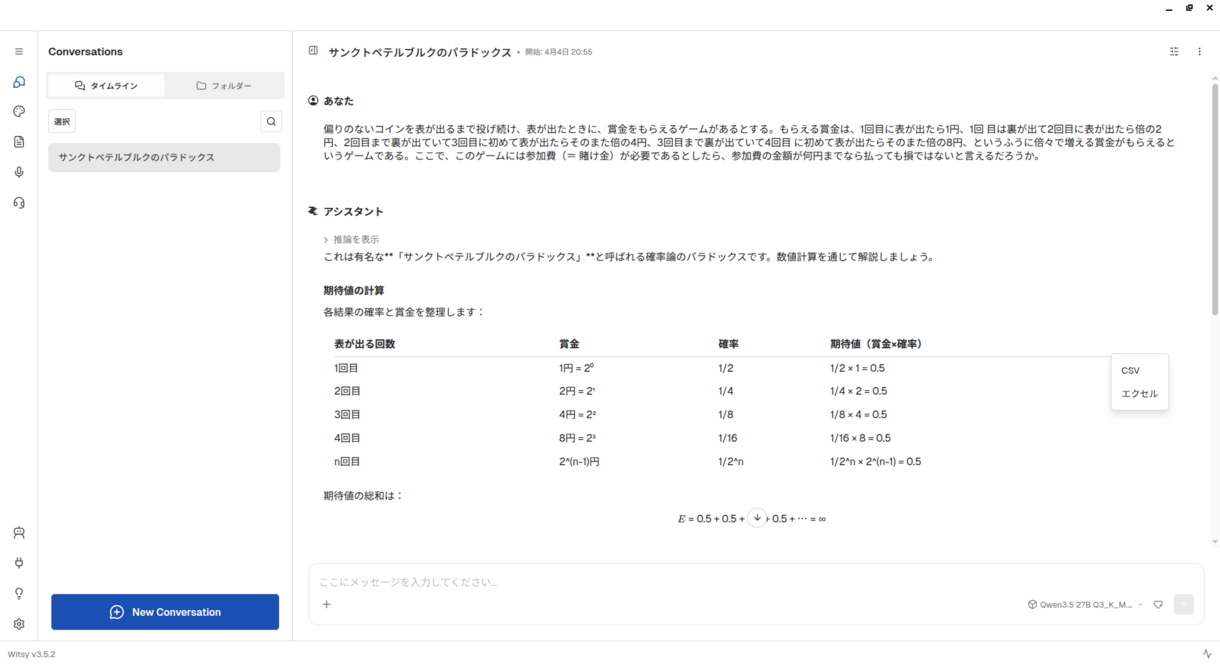

Witsyの便利なところはいろいろありますが、まずは生成した表をCSV/

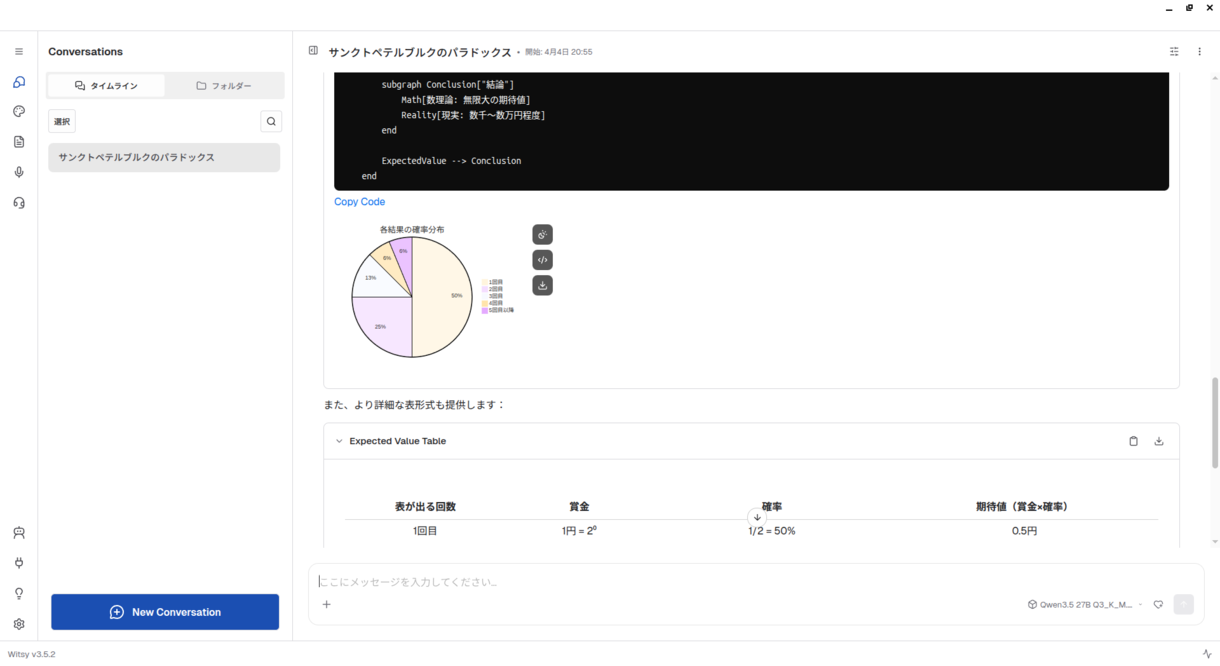

またMarmaid形式で図が作成された場合、レンダリングしてダウンロードもできます

HTMLやPDFでの保存もできます

プラグイン

「設定」-

ファイルシステム

これは指定されたディレクトリ

「有効」

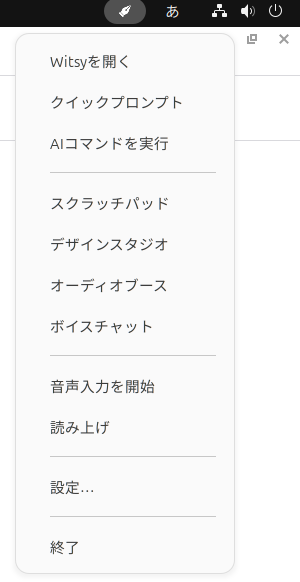

有効にするため、いったんWitsyを再起動します。なおウィンドウを閉じただけでは終了せず、右上の万年筆アイコンをクリックしてメニューを表示し、

試しにローカルのファイルシステムにアクセスできるか確認してみましたが、特に問題なくできているようです。

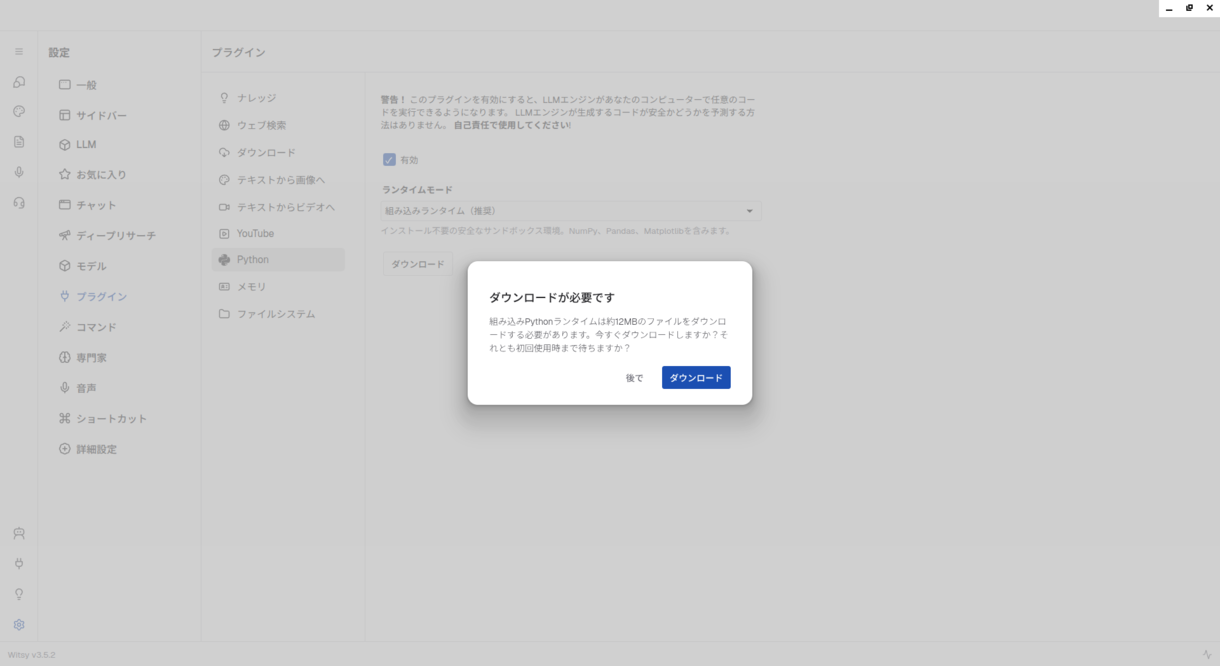

Python

Pythonのプログラムを実行できます。ただし別ウィンドウを表示するようなものには対応しておらず、あくまでコンソールで完結するもののみです。

「有効」

ダウンロード完了後、試しにランダムな文字列でパスワードを生成し、そのファイルを保存するPythonスクリプトを開発してもらいました

このように、プラグインを跨いだ質問にも対応しています。

ウェブ検索

ウェブ検索にも対応しています。エンジンは6種類から選べます。ちょっと使うくらいであれば

その中で一番手軽そうだったのはSearXNGですので、これを使用します。

Dockerを使用しますので、インストールしていない場合はインストールします。

$ sudo apt install docker.io docker-compose-v2 curl $ sudo usermod -aG docker $USER

一旦ここで再起動します。

続けてSearXNGのコンテナを用意します。

$ mkdir -p ./searxng/core-config/

$ cd ./searxng/

$ curl -fsSL -O https://raw.githubusercontent.com/searxng/searxng/master/container/docker-compose.yml \

-O https://raw.githubusercontent.com/searxng/searxng/master/container/.env.example

$ cp -i .env.example .env

SearXNGはデフォルトではポート8080で動作します。今回llama.#SEARXNG_からSEARXNG_に変更します。あくまで今回の例で、都合のいいポートに変更してください。

さらに続けて次のコマンドを実行します。

docker compose up -d docker compose down

すると~/searxng/が生成されます。これをエディターで開き、85行目付近にある箇所を次のように編集します。なお開くときは管理者権限が必要のようです。

formats:

- html

- json

Witsyから検索をする場合はJSON形式を使用するため、これを追加します。

あとはイメージを起動して完了です。

$ docker compose up -d

「設定」-

こちらも再起動しないと有効にならないようです。

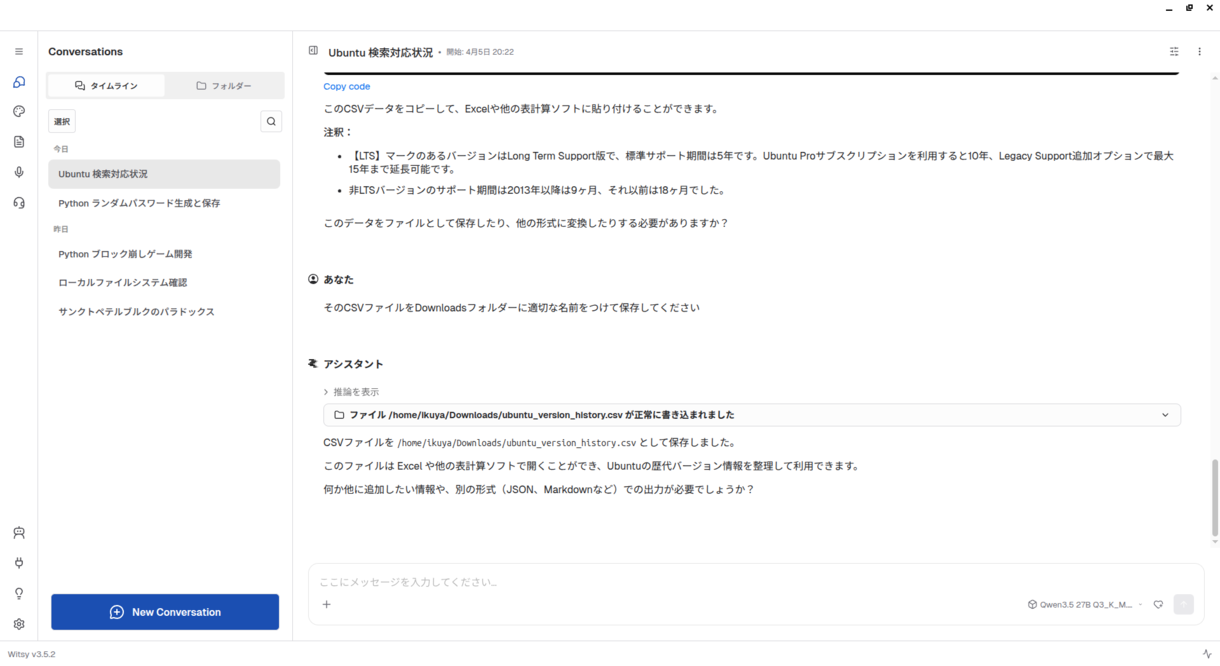

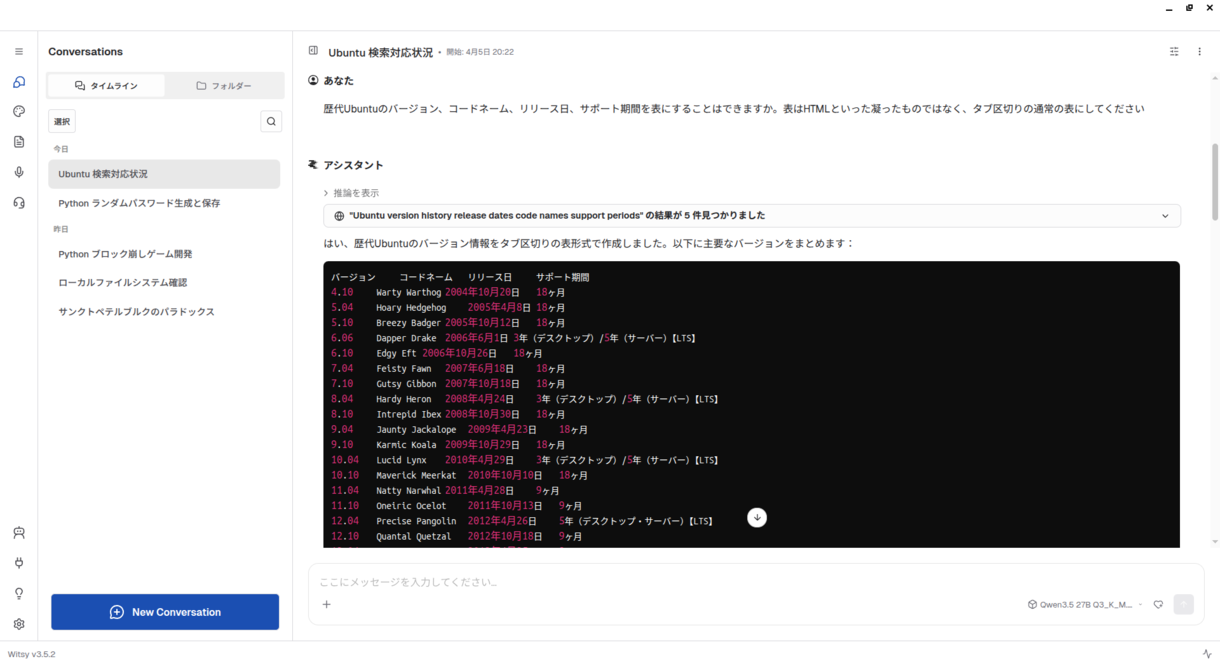

歴代のUbuntuのバージョンを検索結果から表にしてもらいましたが、筆者の記憶にある限りでは正確なので、きちんと検索できているようです

また最初はタブ区切りで表を作ってもらい、それをCSV

もちろんそのファイルを直接保存できます